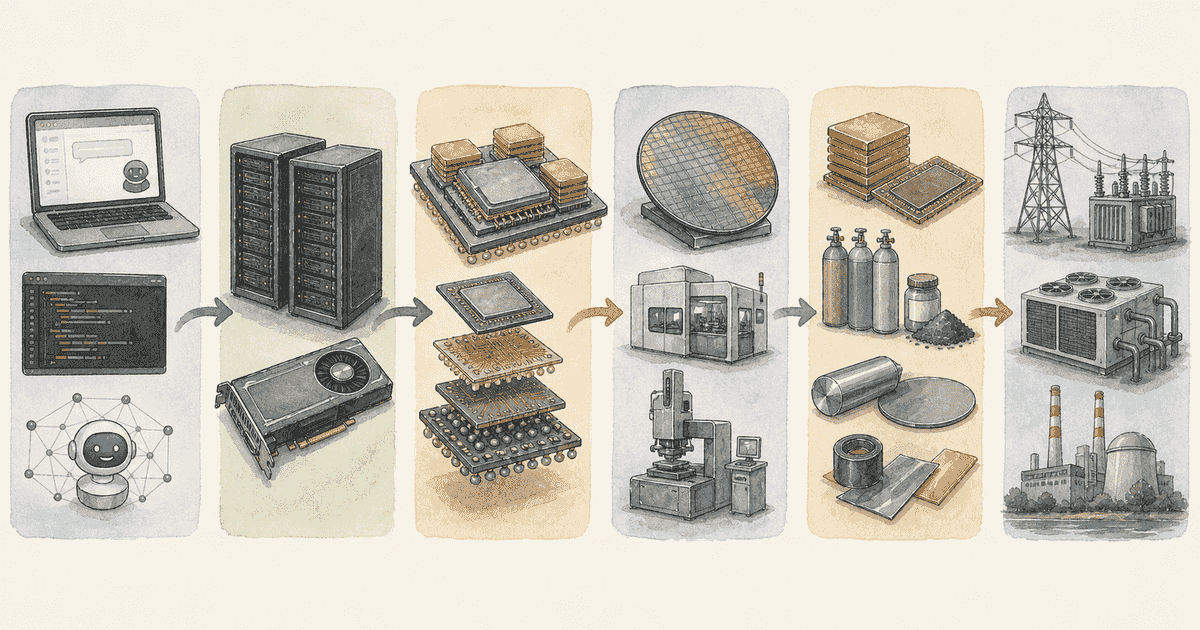

Agentic AI時代の価値連鎖を分解する

モデルラボ、Nvidia、TSMC、メモリ、電力インフラまで

エグゼクティブサマリー

最初に、本稿が何を扱い、どこからが SemiAnalysis の主張で、どこからが筆者自身の解釈かをはっきり分けておきます。

出発点は SemiAnalysis の論考「AI Value Capture - The Shift To Model Labs」です。同記事は、2026 年に入って、AI で稼ぐ場所が「GPU をどれだけ並べたか」から「高い経済価値を生むモデルと、それを動かすシステム全体」へ移ったと整理しています。これは説得力のある見方だと考えます。

そのうえで本稿が独自に主張するのは、その価値はモデルラボだけにとどまらず、NVIDIA のラックやネットワーク、TSMC の先端ノードと先端パッケージ、HBM と SOCAMM、装置、電力・冷却・施工へと、段階的に上流側へ広がっていく、という見方です。これは推論ではあるものの、すでに多くの一次情報で部分的に裏付けが取れています。

モデルラボ側は、Anthropic が公式の価格表で上位モデルを大きく値下げする一方、コーディングと知識労働での性能改善を強調しています。同社は、推論時の思考量が増えるとトークン消費量そのものは増えうるとも明言しています。つまり、1 トークン当たりの価格を下げても、1 タスクで使うトークンが増え、ユーザーが得られる ROI が上がるなら、モデルラボの粗利は上がりうるということです。これは Reuters が報じた Anthropic の年率換算売上 3B ドル超や、Claude Code への強い需要とも同じ方向を指しています。

この粗利改善の規模について、SemiAnalysis はさらに踏み込んで、Anthropic の推論粗利率は従来の約 38% から 70% 超まで改善したと推定しています(同社の独自モデルベース、外部検証は限定的)。本稿の各サブグラフでも、この値を「到達点の代理指標」として参照します。

NVIDIA は引き続き、システム全体の価格を決める中心的な存在です。FY2026 の売上は 215.9B ドル、通期粗利率 71.1%、Q4 粗利率 75.0% を維持しました。Hopper 中心の HGX から Blackwell の「フルスケールデータセンターソリューション」への移行で粗利率は逆風を受けたと年次報告書には書かれていますが、それでもこの水準が出ています。つまり、顧客は単体 GPU ではなく、ネットワーク・ソフトウェア・ラック・AI ファクトリー全体を含めた「システム」と「時間短縮」に対してお金を払っている、と読むのが自然です。

ここで本稿が SemiAnalysis から一歩踏み込みたいのが、SOCAMM の話です。SemiAnalysis は「Rubin/SOCAMM が NVIDIA に新しい価格レバーを与える」と主張しています。本稿はこれを、上流の供給制約と利益プールの再配分まで延長して見ます。実際、Samsung Electronics は 2026 年 Q1 決算で、NVIDIA Vera Rubin 向けの HBM4 と SOCAMM2 の量産販売開始を発表し、下期には Agentic AI が需要成長を加速すると述べました。Micron も SOCAMM を「AI データセンター向け旗艦モジュラー低消費電力メモリ」と位置づけています。SOCAMM は構想ではなく、すでに Rubin 世代の現物として供給が始まっています。SemiAnalysis の価格差別化仮説の中身(具体的なマージン水準)を外から完全に検証することはできませんが、価格差別化の道具として使える「モジュラーな BOM」が現実に存在していることだけは確認できます。

上流への広がりも見えてきています。TSMC は 2025 年の粗利率 59.9%、2026 年 CapEx 52B〜56B ドルを示し、投資の重点に 2nm/3nm と先端パッケージを挙げました。同社は年次報告書で「顧客が見出す価値は当社の価格に反映されている」と明言しています。さらに 2026 年 Q1 の決算説明会では、先端パッケージ能力は依然「very tight」であり、大型 CoWoS が主供給、CoPoS は試験ラインから数年後に量産する計画だと説明しました。HBM とパッケージの逼迫こそが、NVIDIA とモデルラボの超過利潤の一部が上流へ流れる接点になります。

メモリは、もはや「AI に付随する部材」ではありません。Micron は 2026 年度 Q2 で粗利率 74.4%、Q3 ガイダンスで約 81% を示し、クラウドメモリ部門とコアデータセンター部門の粗利率はともに 74% に達しました。Samsung の DS 部門は Q1 2026 に 53.7 兆ウォンの営業利益を計上し、SK hynix も Reuters 経由で AI メモリ需要が製造能力を上回ると述べました。HBM・SOCAMM・高性能 DRAM は、2026 年には「値段の付かない汎用品」ではなく「足りなくて高く売れる戦略部材」になっています。

最後に、電力・冷却・施工はこれからむしろ強くなる可能性が高いと見ています。GE Vernova は 2026 年 Q1 にデータセンター向け電力機器受注だけで 2.4B ドルを獲得し、前年通年を上回りました。Vertiv は Q1 売上 +30%、調整後営業利益率 20.8% で、極端な高密度化・ギガワット級拡張・液冷の重要性を強調しました。Eaton は 1MW 超のラック密度と「grid-to-chip」モジュラー展開を語り、スイッチギア増産投資を行いました。Schneider Electric も Q1 売上 +11.2% オーガニック成長の主役としてデータセンターを挙げました。2026 年の AI 価値連鎖は、SemiAnalysis が描いた「モデルラボへの価値シフト」が起点であっても、投資できる上場市場では、メモリ・パッケージ・電力機器・冷却・施工にまで利益プールが広がっています。

SemiAnalysis の主張と本稿の独自仮説

ここでは、まず SemiAnalysis の主張を要約し、続いて本稿が独自に展開する見方を分けて書きます。

SemiAnalysis の主張(要約)

SemiAnalysis の論点は、ざっくりまとめると次の通りです。

- 2023〜2025 年は AI インフラの供給側(特に GPU)が価値を最も多く取った

- 2026 年以降は、Agentic AI の実用化で「トークン単価」よりも「トークンの経済価値」が再評価され、価値捕捉がモデルラボへ動く

- GPU 単体の価格差別化は反トラスト面で目立つが、メモリやネットワークなど周辺 BOM は価格差別化しやすい

- Rubin 世代の SOCAMM はその新しいレバーになりうる

- Anthropic の推論粗利率は 38%→70%+ へ改善したと推定される(同社モデルベース)

- Claude Code の入力/出力比は 300:1、キャッシュヒット率は 90% 超で、実効ブレンド単価が大きく下がる

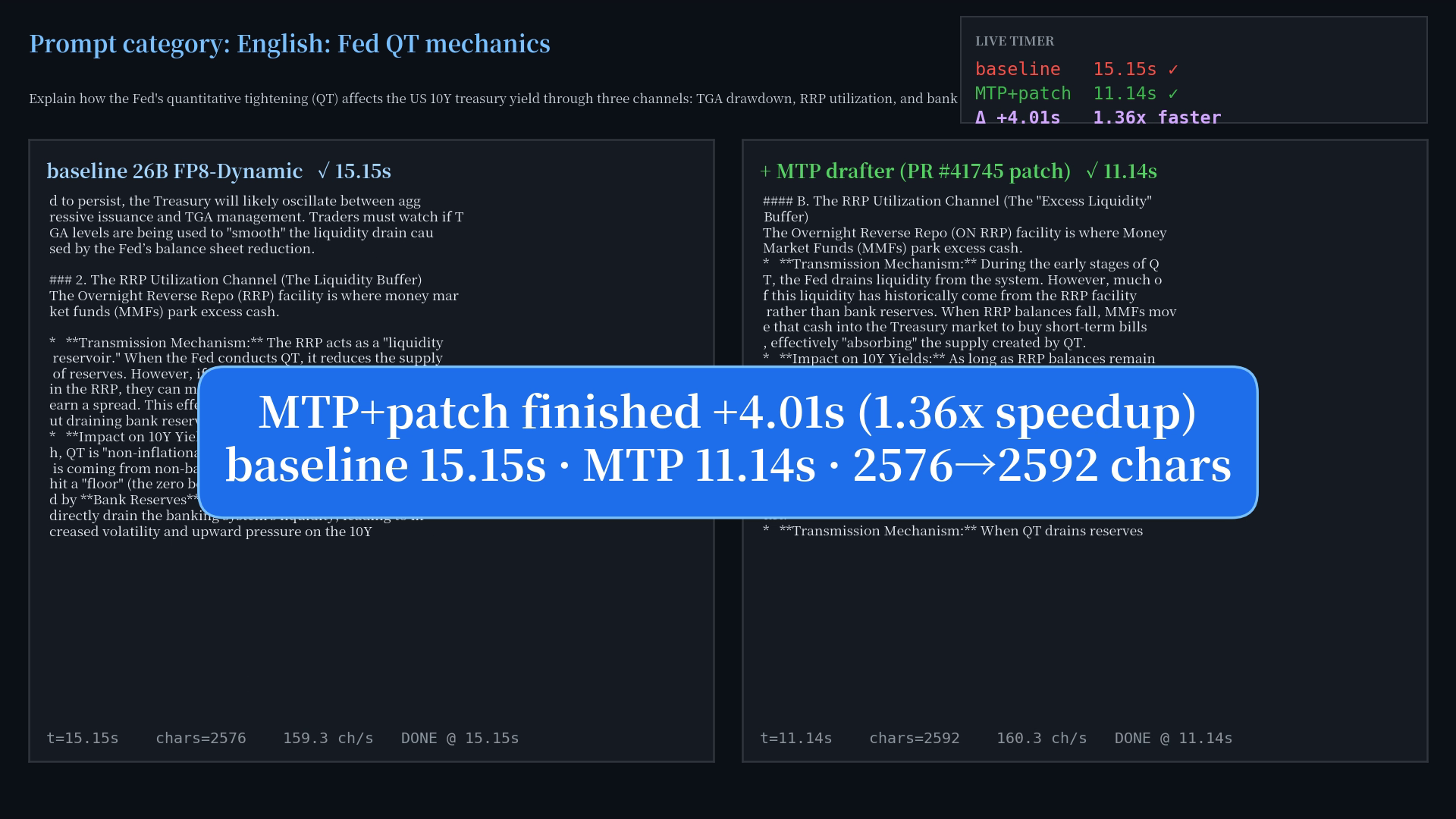

- ソフトウェア最適化(wideEP / disagg / MTP 等)だけで、同じ B300 で 1k → 14k tok/s/GPU の改善(InferenceX ベンチ)

- VR NVL72 の capex/W は GB300(37.4 ドル)→ VR(38.1 ドル)とほぼ横ばいで、NVIDIA はまだ価値を取り切っていないと見られる

- SOCAMM 契約価格は Q1 2026 約 8 ドル/GB → 2026 末 13 ドル/GB の見通しで、NVIDIA は SOCAMM に約 60% のマージンを乗せられる可能性

- VR NVL72 の GPU レンタル価格レンジは下限 4.92 ドル/hr、上限 12.25 ドル/hr で、Neocloud の IRR レンジは 15.6%〜38%

- Premium tier の Mythos(通常 Opus の 5 倍価格)も市場が受け入れる余地がある

これらはいずれも SemiAnalysis の独自モデルや内部データに基づく推定で、外から完全に検証はできません。本稿の各サブグラフと triple テーブルでも、これらの数値は「SemiAnalysis 由来」として参照しており、当サイト独自の数値ではない点をあらかじめ強調しておきます。

本稿の独自仮説

本稿が独自に立てる仮説は、SemiAnalysis の議論をさらに一段上流へ延ばす点にあります。

もし Agentic AI がトークンの経済価値を押し上げ、モデルラボと NVIDIA が価格決定力を維持・強化するなら、その超過利潤は必ず「供給制約が残る物理的な層」へ逆流する——というのが本稿の主張です。

具体的には、先端ノード、CoWoS/SoIC/CoPoS などの先端パッケージ、HBM/SOCAMM/高性能 DRAM、露光・成膜・エッチング・検査装置、ABF 基板、さらに変圧器・スイッチギア・ガスタービン・液冷・データセンター施工へと広がります。これは、単に「AI 需要が大きいから上流も上がる」という話ではありません。価格を上げられる場所と、能力増強に数四半期〜数年かかる場所が重なるところで、最も大きな投資妙味が生まれる、という因果を重視しています。

事実と仮説の切り分け

整理すると、次のようになります。

- 事実として確認できるもの:モデルラボの Agentic 製品拡張、NVIDIA の高粗利維持、TSMC の先端パッケージ逼迫、メモリ各社の高い収益性、装置各社の HBM/パッケージ寄与拡大、GE Vernova や Vertiv の受注・利益拡大

- SemiAnalysis の推定として残るもの:Anthropic 推論粗利の具体水準、SOCAMM 価格・マージン構造、capex/W の解釈、レンタル価格レンジ、Mythos 受容度、TSMC 価格決定の余地

- 本稿が仮説として置くもの:Rubin/SOCAMM が NVIDIA の価格差別化手段として「どこまで」効くか、Neocloud が資金調達を切らさずに中間マージンを維持できるか、モデルラボがエージェントの高価値を価格としてどこまで回収できるか

因果マップ:概観

以下は、本稿の因果整理です。図そのものは筆者の統合ですが、各ノードは上記の一次情報と SemiAnalysis の主張に基づいています。まず全体像を概念レベルで示し、その後で筆者が独自に運用している投資テーマ因果モデルに基づいた詳細サブグラフを 4 枚提示します。

flowchart TD

A["Agentic AIの実用化"] --> B["1タスク当たりのROI上昇"]

A --> C["1タスク当たりのトークン消費増加"]

B --> D["高品質クローズドモデルへのWTP上昇"]

C --> E["推論計算需要の総量増加"]

D --> F["モデルラボの売上/タスク上昇"]

E --> F

F --> G["NVIDIAシステム需要増"]

G --> H["ラックASP・ネットワーク・メモリ実装の価値増"]

H --> I["Rubin/SOCAMM/HBMの付加価値拡大"]

I --> J["TSMC先端ノード/先端パッケージ需要増"]

J --> K["装置・基板・OSAT需要増"]

K --> L["電力・冷却・施工・グリッド需要増"]

M["反論: オープンモデル/ASIC/効率化"] -.-> D

M -.-> G

N["反論: 規制/輸出管理/資金調達"] -.-> G

N -.-> J

N -.-> L

classDef primary fill:#e1f5fe,stroke:#0288d1

classDef counter fill:#ffebee,stroke:#c62828

class A,B,C,D,E,F,G,H,I,J,K,L primary

class M,N counterこのマップで一番大事なのは、コストが下がるのと需要が増えるのが同時に起こることです。Anthropic は上位モデルの価格を下げつつ、より高い努力レベルで長く考えさせることで、トータルのトークンは増えうると説明しています。Agentic AI は、「1MTok 当たりの価格が下がる」よりも「1 件の仕事を終わらせるためのタスク価値」と「総トークン需要」が大きく増えるなら、むしろ売上と利益を引き上げます。これがモデルラボから半導体・電力までを一つの循環に結びつける本質です。

因果マップ:詳細サブグラフ(投資テーマ因果モデル準拠)

ここからは、筆者が別プロジェクトで運用している投資テーマ因果モデル(投資テーマごとにノード/エッジ/イベントルールを CSV で持つ構成)から、本稿の論点に対応する部分を 4 枚のサブグラフに分けて示します。

重要な注記:以下のサブグラフのうち、サブグラフ 1 と 2 で参照する具体数値(Anthropic 推論粗利 38%→70%+、Claude Code 300:1 / 90% hit、SOCAMM 契約価格 8〜13 ドル/GB、NVIDIA メモリ層想定マージン 60%、capex/W 37.4→38.1 ドル、レンタル価格レンジ 4.92〜12.25 ドル/hr、Neocloud IRR 15.6%〜38% など)は、いずれも SemiAnalysis の独自モデルから引用した推定値です。本稿独自に算出したものではありません。サブグラフ 3 と 4 のハードウェア・電力カスケードは、各社の一次情報を内部モデルで構造化したもので、こちらは推定値ではなく工程上の依存関係に基づいています。

因果モデルの読み方(記号と用語)

各サブグラフを読むうえで、3 つだけ用語を共有しておきます。

- ノード ID(A1, A2, …, B1, …, C1, …, D1, …):図の中の各ボックスに振った略号です。本文中で「(A1→A7)」のように参照したときは、サブグラフ 1 の A1(Agentic AI 実用採用率)から A7(トークン市場清算価格)への矢印を指しています。サブグラフ 1 は A、サブグラフ 2 は B、サブグラフ 3 は C、サブグラフ 4 は D で始まります。

- direction(positive / negative):矢印が起点ノードと終点ノードをどう動かすかの符号です。positive は「起点が上がると終点も上がる(同じ方向)」、negative は「起点が上がると終点は下がる(反対方向)」を意味します。例えば「コストが下がる → 粗利が上がる」は negative になります(起点 ↓ → 終点 ↑、つまり逆方向)。

- confidence(0.5〜0.95):その因果関係がどれくらい確からしいかを 0〜1 のスケールで示したものです。0.9 以上は教科書的にほぼ確実(例:HBM 採用量 → TSV 数)、0.7〜0.85 は強い相関(多くのケースで成り立つ)、0.5〜0.65 は条件付き(成り立つ場合と成り立たない場合がある)、と読めます。本稿では各エッジに「positive 0.8」「negative 0.7」のように direction と confidence を併記しています。

なお、この confidence の数値は ベイズ推定や回帰係数のような統計手法で算出したものではありません。論文・一次情報・過去事例の整合性をもとに、モデル設計者(筆者)が定性的に付けたスコアです。直感的な確信度の代理値だと受け取ってください。各サブグラフでは絶対的な数値そのものよりも、「どの因果が頑健で、どの因果が条件付きか」の相対的な強弱を比較する尺度として使うのが適切です。新しい一次情報が出てくるたびに、モデル側で値を見直します。

サブグラフ1:Agentic AI の経済学(推論コスト・市場価格・粗利の連動)

このサブグラフは、Agentic AI の実用化がモデルラボの推論粗利率にどう波及するかを示します。SemiAnalysis が推定する「Anthropic 推論粗利 38% → 70%+」への到達経路は、価格上昇とコスト低下の両側から同時に効く構造になっています。なお、図中の各数値(300:1、90% hit、wideEP/disagg/MTP の効果など)はすべて SemiAnalysis の推定です。

flowchart TD

A1["A1: Agentic AI 実用採用率"]

A2["A2: Agentic ワークロード I/O 比 + キャッシュヒット率<br/>(SemiAnalysis 推定: Claude Code 300:1 / 90% hit)"]

A3["A3: 推論ソフトウェア最適化<br/>(wideEP / disagg / MTP)"]

A4["A4: KV cache 圧縮普及度<br/>(DeepSeek V4 CSA/HCA)"]

A5["A5: 推論総ワークロード量<br/>(Jevons paradox 下流)"]

A6["A6: 1 トークン製造コスト"]

A7["A7: トークン市場清算価格<br/>(バリューベース上限)"]

A8["A8: 閉鎖フロンティアモデル優位度"]

A9["A9: AI ラボ価格決定力"]

A10["A10: AI ラボ推論粗利率<br/>(SemiAnalysis 推定: Anthropic 38%→70%+)"]

A11["A11: Premium tier モデル需要<br/>(SemiAnalysis: Mythos / Opus fast)"]

A1 -->|positive 0.8| A2

A1 -->|positive 0.8| A5

A1 -->|positive 0.8| A7

A2 -->|negative 0.7| A6

A3 -->|negative 0.7| A6

A3 -->|positive 0.5| A4

A4 -->|positive 0.7| A5

A6 -->|negative 0.8| A10

A7 -->|positive 0.7| A10

A8 -->|positive 0.6| A9

A9 -->|positive 0.5| A11

A11 -->|positive 0.5| A7

classDef demand fill:#e1f5fe,stroke:#0288d1

classDef cost fill:#fff3e0,stroke:#ef6c00

classDef price fill:#f3e5f5,stroke:#8e24aa

classDef margin fill:#e8f5e9,stroke:#388e3c

class A1,A2,A5 demand

class A3,A4,A6 cost

class A7,A8,A9,A11 price

class A10 marginここで読み取れるのは、Agentic AI の実用化(A1)が、3 つの経路を同時に動かしているということです。

- (a) 価格を引き上げる経路(A1 → A7、positive):Agentic AI が実用化すると、トークンの市場清算価格(A7)が上がります

- (b) コストを引き下げる経路(A1 → A2、positive)→(A2 → A6、negative):Agentic AI で入力比とキャッシュヒット率が歪み(A2)、その歪みが 1 トークン製造コスト(A6)を下げます(A2→A6 は negative なので、A2 が上がると A6 が下がる)

- (c) 需要を増やす経路(A1 → A5、positive):推論総ワークロード量(A5)も同時に増えます

そして、粗利率(A10)に入る矢印は 2 本あります。

- A7 → A10(positive):価格(A7)が上がると、粗利率(A10)も上がる

- A6 → A10(negative):コスト(A6)が下がると、粗利率(A10)が上がる(負の相関なので、A6 ↓ → A10 ↑)

つまり、価格側から押し上げる力(A7→A10)とコスト側から押し上げる力(A6→A10)が、同時に A10 に流れ込む構造になっています。SemiAnalysis が推定した Anthropic 38%→70%+ の改善は、この構造の代理指標として、本サブグラフは無理なく説明できます。

サブグラフ2:NVIDIA の価格レバーと SOCAMM の役割

このサブグラフは、SemiAnalysis の主張「NVIDIA は GPU 本体では値上げしにくいが、メモリ・ネットワークなど周辺 BOM では価格差別化できる」を、内部モデルのノード ID で表現したものです。図中の SOCAMM 契約価格(8→13 ドル/GB)、想定マージン 60%、capex/W(37.4→38.1 ドル)、レンタル価格レンジ(4.92〜12.25 ドル/hr)、Neocloud IRR(15.6%〜38%)はすべて SemiAnalysis のモデル推定です。

flowchart TD

B1["B1: SOCAMM 契約価格<br/>(SemiAnalysis 推定: $8/GB Q1→$13/GB 2026 末)"]

B2["B2: NVIDIA メモリ層価格決定力<br/>(SemiAnalysis 想定: SOCAMM ~60% margin)"]

B3["B3: NVIDIA ネットワーク価格差別化<br/>(SemiAnalysis: SN5610 Neocloud vs HSC 2x)"]

B4["B4: NVIDIA GPU 値上げ抑制度<br/>(反トラスト懸念由来)"]

B5["B5: VR NVL72 capex per watt<br/>(SemiAnalysis: GB300 37.4 → VR 38.1 ドル)"]

B6["B6: GB300→VR FLOP/$ 改善<br/>(SemiAnalysis: 顧客側 60% コスト低下)"]

B7["B7: VR NVL72 GPU レンタル価格レンジ<br/>(SemiAnalysis: $4.92-$12.25/hr/GPU)"]

B8["B8: Neocloud IRR レンジ<br/>(SemiAnalysis: 15.6%-38%)"]

B9["B9: Nvidia Rubin/H200 世代交代ペース"]

B1 -->|positive 0.7| B2

B2 -->|positive 0.6| B5

B3 -->|positive 0.4| B2

B4 -.->|negative 0.5| B5

B6 -->|positive 0.7| B7

B5 -->|positive 0.6| B7

B7 -->|positive 0.7| B8

B2 -->|positive 0.5| B9

classDef lever fill:#f3e5f5,stroke:#8e24aa

classDef restraint fill:#ffebee,stroke:#c62828

classDef econ fill:#e1f5fe,stroke:#0288d1

classDef return fill:#e8f5e9,stroke:#388e3c

class B1,B2,B3 lever

class B4 restraint

class B5,B6,B7,B9 econ

class B8 returnこのサブグラフは、左側(B1〜B4:価格レバー側)から右側(B5〜B9:システム経済性とリターン側)への流れで読みます。

価格レバー側の構造(B1〜B4)

- B4(GPU 本体の値上げ抑制) → B5(capex/W)、negative:NVIDIA は反トラスト懸念で GPU ダイ単体の値上げをしにくいため、capex/W の上昇は限定されます(破線・confidence 0.5 で「条件付き」扱い)

- そこで NVIDIA は、代わりに B1(SOCAMM 契約価格)→ B2(メモリ層価格決定力)、positive 0.7 と、B3(ネットワーク価格差別化)→ B2、positive 0.4 という 2 本の「差別化レバーの兄弟」でシステム ASP を上げる、というのが SemiAnalysis の見立てです

- GB300 → Vera Rubin で capex/W が 37.4 → 38.1 ドルとほぼ横ばいに見える違和感は、この B4 の抑制が効いているためで、その分を B1・B3 の側で補っている、と読めます

システム経済性とリターン側の構造(B5〜B9)

VR Rubin は性能が GB300 より大きく上がるため、顧客の感じる経済性も大きく改善します。これが B6 → B7 → B8 の連鎖を生みます。

- **B6(GB300→VR FLOP/12.25/hr)が広く取れる

- B5(capex/W) → B7、positive 0.6:capex/W が上がれば Neocloud の減価償却負担も上がり、IRR を維持するための最低レンタル価格(コストベース下限 = $4.92/hr)が押し上げられる

- B7(レンタル価格レンジ:12.25/hr) → B8(Neocloud IRR レンジ:15.6%〜38%)、positive 0.7:レンタル価格の上限が高く取れる場面では、Neocloud は IRR レンジの上限(38%)に届きやすくなる

- B2(NVIDIA メモリ層価格決定力) → B9(Rubin/H200 世代交代ペース)、positive 0.5:メモリで高マージンを取れる NVIDIA は、Rubin / Rubin Ultra への投資原資を確保できるため、世代交代ペースを維持・短縮できる(このループで再び需要を呼び込む)

まとめると、B6 起点で「VR の価値が高い」ことが B7(レンタル価格)と B8(Neocloud IRR)を同時に押し上げ、システム全体としては NVIDIA・Neocloud・顧客のいずれにも価値が残る構造になっています。SemiAnalysis はここに着目し、「NVIDIA はまだこの価値を取り切っていないので、価格をもっと上げる余地がある」と論じています。

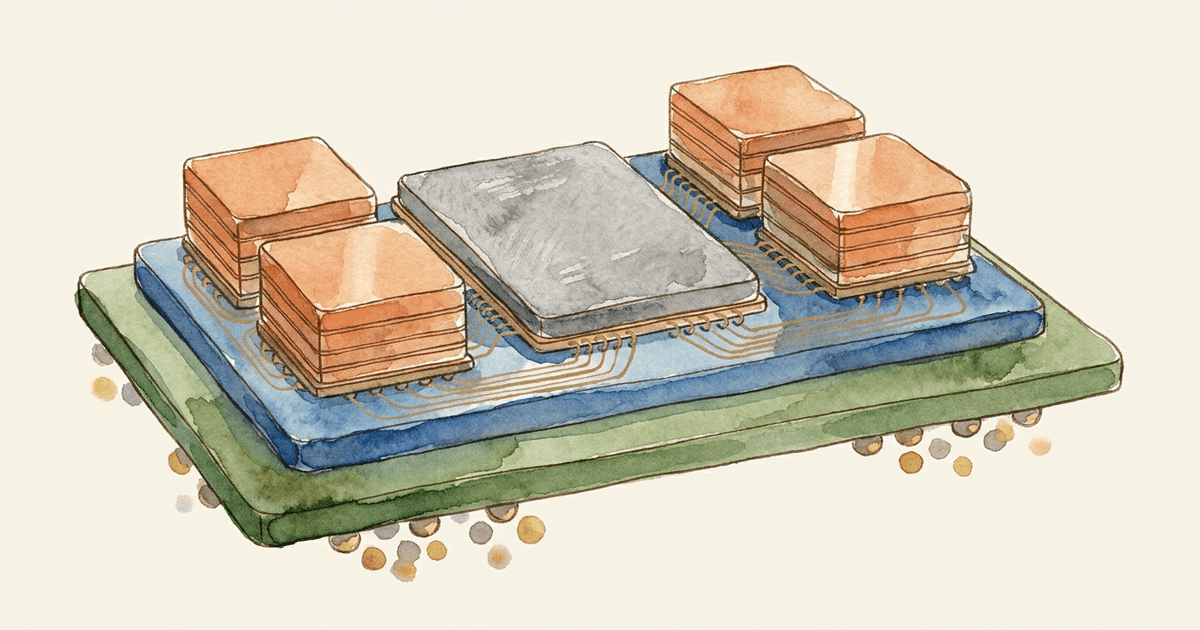

サブグラフ3:ハードウェア需要カスケード(GPU → HBM → パッケージ → 装置)

GPU 出荷量の増加は、HBM、TSV、SLT テスト、エッチング装置、ABF 基板まで、ほぼそのまま下流に波及します。各エッジの confidence が高い(0.85〜0.95)のは、これらが工程上の物理的な依存関係だからです。本サブグラフの数値は内部モデルのものですが、SemiAnalysis 推定ではなく、各社の一次開示と工程設計の知見をもとにモデル化したものです。

flowchart TD

C1["C1: ハイパースケーラー Capex"]

C2["C2: AI データセンター建設速度"]

C3["C3: GPU/AI アクセラレータ出荷量"]

C4["C4: HBM4 採用ボリューム"]

C5["C5: HBM4 TSV 配線複雑性<br/>(HBM3E 比 TSV 数 4 倍)"]

C6["C6: HBM SLT テスト時間"]

C7["C7: HBM SLT テスタ需要<br/>(Advantest 寄り)"]

C8["C8: 前工程エッチング装置需要<br/>(LRCX / TEL)"]

C9["C9: ABF 基板需要<br/>(Ibiden)"]

C10["C10: ABF フィルム需要<br/>(味の素)"]

C11["C11: TSMC 先端ノードキャパ<br/>(N3/N4 残余)"]

C12["C12: compute die 巨大化サイクル"]

C13["C13: TSMC CoWoS-L 実効キャパ"]

C1 -->|positive 0.9| C2

C2 -->|positive 0.9| C3

C3 -->|positive 0.95| C4

C4 -->|positive 0.95| C5

C5 -->|positive 0.9| C6

C6 -->|positive 0.95| C7

C5 -->|positive 0.8| C8

C3 -->|positive 0.9| C9

C9 -->|positive 0.95| C10

C3 -->|negative 0.8| C11

C3 -->|positive 0.75| C12

C12 -->|negative 0.6| C13

classDef macro fill:#e1f5fe,stroke:#0288d1

classDef hbm fill:#f3e5f5,stroke:#8e24aa

classDef equip fill:#fff3e0,stroke:#ef6c00

classDef bottleneck fill:#ffebee,stroke:#c62828

class C1,C2,C3 macro

class C4,C5,C6 hbm

class C7,C8,C9,C10 equip

class C11,C12,C13 bottleneckこのサブグラフが示すのは、GPU 出荷量(C3)から下流のほぼすべての工程指標が confidence 0.85〜0.95 でそのまま決まるということです。HBM4 の TSV 数が HBM3E 比で 4 倍に増えること(C4→C5)、SLT テスト時間がそれに比例して延びること(C5→C6)、結果として SLT テスタ需要が直接押し上げられること(C6→C7)は、いずれも工程設計上避けられない関係です。同時に、GPU 量産は TSMC 先端キャパ(C11)と CoWoS-L キャパ(C13)を負方向に消費します。これが上流の供給逼迫を生み、価格決定力を上流に移す物理的な根拠になります。

サブグラフ4:データセンター電力・冷却・グリッドのカスケード

このサブグラフは、データセンターの電力・冷却・グリッド側を扱います。データセンター建設パイプラインから、電力需要、グリッド接続待機、ガスタービン、液冷へとつながる構造を、各社の一次情報をもとにモデル化したものです。

flowchart TD

D1["D1: グローバル AI 設備投資コミット"]

D2["D2: DC 建設パイプライン"]

D3["D3: DC 電力需要 (MW)"]

D4["D4: DC 冷却システム需要"]

D5["D5: DC 系統連系待機期間"]

D6["D6: 送配電網 Capex<br/>(GE Vernova / Eaton 寄り)"]

D7["D7: 液浸冷却・液冷市場<br/>(Vertiv 寄り)"]

D8["D8: DC オンサイトガスタービン採用"]

D9["D9: ガスタービン EPC 需要"]

D10["D10: DC 向け定置型蓄電池市場"]

D11["D11: DC 立地制約<br/>(系統余裕地域分散)"]

D12["D12: AI ラボ自走 capex<br/>(高粗利由来の内部留保)"]

D12 -->|positive 0.7| D1

D1 -->|positive 0.85| D2

D2 -->|positive 0.9| D3

D2 -->|positive 0.85| D4

D2 -->|positive 0.85| D5

D3 -->|positive 0.8| D6

D4 -->|positive 0.75| D7

D5 -->|positive 0.8| D8

D5 -->|positive 0.75| D10

D5 -->|positive 0.7| D11

D8 -->|positive 0.85| D9

classDef driver fill:#e8f5e9,stroke:#388e3c

classDef build fill:#e1f5fe,stroke:#0288d1

classDef power fill:#fff3e0,stroke:#ef6c00

classDef bottleneck fill:#ffebee,stroke:#c62828

class D1,D12 driver

class D2,D3,D4 build

class D6,D7,D9,D10 power

class D5,D8,D11 bottleneck特に注目したいのは、D5(系統連系待機期間)が D8(オンサイトガスタービン)、D10(BESS 蓄電池)、D11(立地制約)の 3 つを同時に発生させるハブになっている点です。グリッド接続が遅いほど、データセンター事業者はガスタービン自家発電や蓄電池に頼らざるを得なくなります。GE Vernova のバックログ急増、Eaton のスイッチギア増産、Vertiv の液冷拡大は、いずれもこの D5 を起点とした分岐の下流にあると整理できます。

もう一つ注目したいのが、D12(AI ラボ自走 capex) → D1(グローバル AI 設備投資)、positive 0.7 というエッジが、サブグラフ 1 とサブグラフ 4 をつなげている点です。具体的には、次のループが成り立ちます。

- サブグラフ 1 で、AI ラボの推論粗利率(A10)が上がる(SemiAnalysis 推定で 38% → 70%+)

- その高粗利が、AI ラボの内部留保(自前資金)として積み上がる(D12)

- それが、外部の資本市場に頼らずに AI 設備投資(D1)を続ける燃料になる

- その設備投資が、DC 建設パイプライン(D2)以降の電力・冷却・グリッド需要に流れていく

つまり、サブグラフ 1 でモデルラボに溜まった利益が、(株式や債券の発行を経由せずに)サブグラフ 4 のグローバル AI 設備投資の原資になる、という関係です。ただし、このループは SemiAnalysis の推定する高粗利(A10)が成り立っていることが大前提なので、ここが崩れるとループ全体が止まるリスクは残ります。

主要因果 triple(pack 由来・抜粋)

上記 4 サブグラフから、本稿の主張に直結する因果 triple を 18 件抽出しました。direction と confidence は内部モデルの値そのままです。なお、triple #1〜#9 で参照している価格・粗利・マージン関連の数値は、再掲ですがいずれも SemiAnalysis の推定に基づくものです(独立に検証されたものではありません)。triple #10〜#18 は工程・物理依存関係に基づくもので、より頑健な部類に属します。

| # | 起点ノード | relation | 終点ノード | direction | conf. | 解釈 |

|---|---|---|---|---|---|---|

| 1 | agentic_ai_practical_adoption | value_realization | token_market_clearing_price | positive | 0.8 | Agentic AI が実用化して知的労働の対価が値段として表に出るようになり、市場清算価格が上がる(SemiAnalysis) |

| 2 | agentic_workload_input_heavy | cache_hit_economics | token_production_cost | negative | 0.7 | 入力比 300:1 + キャッシュヒット率 90% で実効ブレンド単価が大きく下がる(SemiAnalysis) |

| 3 | inference_software_optimization | sw_throughput_gain | token_production_cost | negative | 0.7 | wideEP/disagg/MTP で 1k → 14k tok/s/GPU、HW 償却コストが大幅低下(SemiAnalysis InferenceX) |

| 4 | token_production_cost | cost_to_margin | ai_lab_inference_gross_margin | negative | 0.8 | コスト低下が AI ラボ推論粗利を引き上げる主要因子(SemiAnalysis 推定の到達点) |

| 5 | token_market_clearing_price | price_to_margin | ai_lab_inference_gross_margin | positive | 0.7 | 価格上昇も粗利改善に直接寄与(SemiAnalysis) |

| 6 | ai_lab_inference_gross_margin | self_funded_capex | macro_ai_capex_global | positive | 0.5 | 高粗利が自走 capex を可能にし AI 設備投資全体を押し上げる |

| 7 | socamm_contract_price | memory_lever_realization | nvidia_memory_pricing_power | positive | 0.7 | $8→$13/GB はメモリ層を独立価格項目として扱える証拠(SemiAnalysis) |

| 8 | nvidia_gpu_pricing_restraint | gpu_restraint_caps_capex | vr_nvl72_capex_per_watt | negative | 0.5 | GPU 本体の値上げ抑制が capex/W 上昇を限定する根源(SemiAnalysis) |

| 9 | nvidia_network_segmentation | segmentation_siblings | nvidia_memory_pricing_power | positive | 0.4 | SN5610 と SOCAMM は同じ「差別化レバー戦略」の兄弟(SemiAnalysis) |

| 10 | macro_datacenter_buildout | gpu_procurement | asic_gpu_unit_volume | positive | 0.9 | DC 建設加速は GPU 調達量を直接引き上げる |

| 11 | asic_gpu_unit_volume | direct_memory_demand | hbm_hbm4_adoption_volume | positive | 0.95 | GPU は世代あたり 6-12 HBM スタック、最上流ドライバー |

| 12 | hbm_hbm4_adoption_volume | tsv_count_4x | hbm_tsv_complexity | positive | 0.95 | HBM4 は HBM3E 比で TSV 数 4 倍、工程複雑性が大幅上昇 |

| 13 | hbm_slt_test_time | tester_volume | equip_hbm_slt_demand | positive | 0.95 | テスト時間延長 → SLT テスタ調達増(Advantest 受益) |

| 14 | asic_gpu_unit_volume | flipchip_substrate | pack_abf_substrate_demand | positive | 0.9 | AI GPU は大型 flip-chip で ABF 基板需要が直接増 |

| 15 | asic_gpu_unit_volume | capacity_consumption | asic_tsmc_leading_capacity | negative | 0.8 | GPU 量産は TSMC 先端キャパを消費し残余を逼迫 |

| 16 | dc_construction_pipeline | build_to_grid_queue | dc_grid_interconnection_lead_time | positive | 0.85 | DC 建設加速は系統連系待機を長期化 |

| 17 | dc_grid_interconnection_lead_time | queue_to_onsite_gen | gas_turbine_onsite_generation | positive | 0.8 | 連系待機が長いほどオンサイト自家発電へシフト |

| 18 | dc_cooling_system_demand | cooling_to_liquid | liquid_cooling_market | positive | 0.75 | 冷却需要拡大の主要受益は液冷市場 |

レイヤー別分析

モデルラボ

Agentic AI を投資テーマとして見るとき、最初に確認すべきは「モデル性能が本当に課金力に変わっているか」です。控えめに見ても、答えはイエスに近いと思います。Anthropic は Opus 4.7 の価格を入力 5 ドル/MTok、出力 25 ドル/MTok とし、旧世代上位モデル Opus 4.1 の 15 ドル/75 ドルから大きく引き下げる一方、コード品質や知識労働の評価で改善を訴えています。Claude Code では標準努力レベルを xhigh に上げ、より長いタスクへ対応しています。性能改善とトークン単価低下が同時に起きているということです。

ただ、Anthropic 自身は、Opus 4.7 の更新で同一入力が 1.0〜1.35 倍のトークンに変換されうること、エージェント設定では後半ターンほど推論量が増え出力トークンも増えることを明示しました。つまり、「1 トークン当たりの価格」は下がっても、「1 件の仕事当たりの請求額」は下がらず、むしろ上がる可能性すらあるわけです。この構造は、定額制ではなく従量課金やタスク課金へ移行するほど収益化しやすくなります。Reuters は Anthropic の年率換算売上が 3B ドルを超え、年初から 4 倍近く拡大したと報じており、SemiAnalysis が強調した「Claude Code が企業利用を押し上げる」という見方とも同じ方向を指しています。

ここでさらに踏み込むと、SemiAnalysis は同社モデルベースで Anthropic の推論粗利が 38% から 70%+ に改善したと推定しています。本稿はこの推定が妥当だと前提を置きますが、Anthropic 公表ではないので確証はありません。同じく SemiAnalysis は、Premium tier の Mythos(通常 Opus の 5 倍価格)も AI 活用に積極的な企業は受け入れる、と見ています。

また、OpenAI の Codex は「command center for agentic coding」として、並列エージェントが数週間分の作業を数日で進めることを訴えています。Google の Gemini Code Assist も、開発ライフサイクル全体の支援をうたっています。市場は「チャット」から「作業遂行」へ移りつつあり、高品質モデルへの支払いは「トークン」ではなく「省力化された仕事量」に対して行われるようになっています。これが本稿で言う「token economic value」の上昇です。

GPUとシステム

NVIDIA の価値捕捉は、もはや GPU ダイ単体では測れません。FY2026 の売上 215.9B ドル、通期粗利率 71.1%、Q4 粗利率 75.0% という数字は、同社がなお強い価格決定力を持つことを示しています。年次報告書では、Blackwell 世代への移行と H20 関連の 4.5B ドルの在庫・購買義務費用が粗利の逆風だったと説明されていますが、それでもこの水準の粗利を維持している以上、顧客は GPU チップではなくシステム、ソフトウェア、供給確実性、時間短縮に対価を払っていると読むのが自然です。

NVIDIA のネットワーク面でも、Spectrum-X は AI クラウド向けに 1.6 倍のネットワーク性能改善をうたい、ラックスケール構成では 1 ラック最大 256 GPU までを統合すると説明しています。SN5610 は 64 ポート 800GbE、51.2Tb/s 級のスイッチとして販売されています。ネットワークは付帯製品ではなく、AI ファクトリーの性能と稼働率を決める収益レバーです。SemiAnalysis は「ネットワークはすでに価格差別化に使われている」(具体例として SN5610 の Neocloud 向け価格はハイパースケーラー向けの約 2 倍とされる)と論じており、少なくとも「製品上の差別化可能性」という意味では同じ方向の話だと思います。

Rubin/SOCAMM については、ここで事実と仮説をきっちり分けたいと思います。

- 事実:Samsung は Vera Rubin 向けに HBM4 と SOCAMM2 の量産販売開始を公表。Micron は SOCAMM を AI データセンター向け旗艦メモリと位置づけている。Nebius も Meta 向けの長期契約を Vera Rubin の大規模導入ベースで締結

- SemiAnalysis の推定:SOCAMM 契約価格は Q1 2026 約 8 ドル/GB → 2026 末 13 ドル/GB、NVIDIA は SOCAMM に約 60% のマージンを乗せられる、capex/W は GB300 37.4 → VR 38.1 ドル

- 本稿が乗る仮説:SOCAMM のモジュラー性が NVIDIA に「ラック全体での価格差別化余地」を与えるかどうか

SOCAMM のマージン構造そのものは外から完全に検証できません。だが、Rubin 世代で「価格を載せやすい追加 BOM」が現実に存在していることだけは一次情報から確認できます。

Neocloud

Neocloud は、モデルラボとハイパースケーラーの間で AI 容量を売る中間層で、2026 年に最も評価が難しいレイヤーでもあります。CoreWeave は 2025 年売上 5.13B ドル、Adjusted EBITDA 3.09B ドル、受注残 66.8B ドルを開示し、投資家向け資料では長期調整後営業利益率 25〜30% を目標としています。需要さえ確保できれば、Neocloud にも十分な運営レバレッジがあることを示しています。

ただし、Neocloud は同時に最も資本集約的でもあります。Reuters は CoreWeave が 2026 年に 30B〜35B ドルの CapEx を計画し、長期債務 14B ドル超を抱えると報じました。Nebius も Meta との契約額が最大 27B ドルに達する一方、その実現には大規模な Rubin 容量立ち上げと継続的な資本調達が必要です。Neocloud は、需要のベータは高いものの、財務と顧客集中リスクも極めて高い水準にあります。投資家の観点では、これは「NVIDIA 代替」ではなく、「AI 需要が継続する限り上振れ余地が大きい高レバレッジ中間層」として位置づけるのが妥当です。

なお、SemiAnalysis のフレームワーク(“One Chart to Rule Them All”)では、VR NVL72 の場合、Neocloud がコストベースで必要とする最低レンタル価格は約 4.92 ドル/hr/GPU、バリューベースの上限は約 12.25 ドル/hr/GPU と推定されています。Neocloud の IRR レンジは 15.6%(下限)〜 38%(上限)。同社はここに、NVIDIA がまだ価値を取りに行く余地が残っている、と見ています。本稿はこの推定をそのままレンジ感として使っています。

ファウンドリと先端パッケージ

TSMC は、この価値連鎖の中で最も安定して価格を取り続ける上流コアです。2025 年の年次報告書では、総粗利率 59.9%、年間 CapEx 40.9B ドル、2026 年見通し 52B〜56B ドル、投資重点として 2nm/3nm と先端パッケージを提示しました。同社は「顧客が見出す価値は当社の価格に反映される」とも明言しており、単なる数量勝負ではなく価値ベースの価格形成を行っています。2025 年には 3nm 売上比率 24%、7nm 以下の先端技術比率 74% まで上昇しており、AI が先端ミックスを押し上げているのは明らかです。

パッケージ側はさらに強い構造です。TSMC は 2026 年 Q1 説明会で、先端パッケージ能力は「very tight」であり、顧客需要を支えるため OSAT とも連携していると述べました。大型レチクル向けでは大型 CoWoS が依然主力で、CoPoS はパイロットラインから数年後に量産する計画とのことです。NVIDIA/モデルラボが価値を取れても、物理的に AI システムを作れる量は CoWoS/CoPoS/SoIC/基板/熱設計に制約されます。SemiAnalysis の仮説の中で、最も高い確率で上流へ価値伝播が起きる場所はここだと思います。

なお SemiAnalysis は、TSMC を「世界で最も公正な会社」と(やや皮肉を込めて)呼んでおり、需要が極端に強くても価格を最大化していない、もっと値上げしても顧客は受け入れるはず、と論じています。本稿はこの主張に賛同しつつも、TSMC が大幅な価格改定よりも長期契約・キャパコミット・前払い金で対応するという SemiAnalysis 自身の補足の方が、現実的な見立てだと考えます。

メモリ

2026 年時点で、メモリはこの価値連鎖の中で最も急激に「価格決定力のある高収益財」へ変わった層です。Micron は 2026 年度 Q2 で売上 23.86B ドル、粗利率 74.4%、Q3 ガイダンス粗利率約 81% を提示し、クラウドメモリ事業とコアデータセンター事業の粗利率はいずれも 74% でした。記憶装置ベンダーの粗利としては異例で、AI メモリが事実上の戦略資産になっていることを示しています。

Samsung も同様です。DS 部門は Q1 2026 に 81.7 兆ウォン売上、53.7 兆ウォン営業利益を計上し、メモリ事業は記録的売上・利益となりました。同社は HBM4 と SOCAMM2 の Rubin 向け量産販売開始を公表し、H2 2026 にはAgentic AI がサーバーメモリ需要を加速すると予測しました。SK hynix も Reuters 経由で、AI チップ需要が製造能力を上回り、供給・価格のひっ迫が続くと述べています。メモリの AI 向け領域は、もはや旧来のシクリカルな汎用品 DRAM の発想では捉えきれません。

装置と素材

AI の上流への波及を最も素直に認めているのが装置メーカーです。ASML は 2025 年年次報告書で、AI ロジックとメモリの強い需要、高価格、需給不均衡が装置市場成長を押し上げると述べ、AI が先端ロジックと DRAM へのミックスシフトを生み、より多くの EUV 露光が必要だと整理しています。装置市場の構成そのものが AI で高付加価値側へ寄っている、ということです。

Applied Materials はさらに踏み込んでおり、AI 計算は HBM DRAM で標準 DRAM の 3〜4 倍の wafer starts per delivered bit を必要とし、HBM スタックも 12 段から 16 段、さらに 20 段超へ増えるため、パッケージと前工程の両方を押し上げると説明しました。2026 年に最も成長する先端パッケージ分野は HBM と 3D chiplet-stacking だとも述べています。Lam Research は 2026 年の先端パッケージ売上が 50% 超成長見込み、KLA は foundry/logic、memory、advanced packaging、services のすべてで AI インフラ構築の恩恵を強調しました。Tokyo Electron も FY2026 に AI サーバー向け先端ロジックと DRAM/HBM 投資の継続、および先端パッケージでの POR 獲得を語っています。

素材については公開情報が薄いものの、基板はかなり有望です。ASE Technology Holding は Reuters ベースで 2026 年の先端パッケージ売上が 3.5B ドル超になる見通しを示し、Ibiden は AI サーバー/高性能サーバー向け高性能 IC パッケージ基板の増産に 500B 円を投じる計画を発表しました。純化学材料や消耗品の個社開示はまだ薄く、本稿では強い投資判断は避けますが、少なくとも先端パッケージ周辺の基板・OSAT は「AI 需要が来ている」ことを公式開示しています。

電力・冷却・施工

最終的に AI クラスターは、電力を食う物理的な設備です。GE Vernova は Q1 2026 に受注 18.3B ドル、バックログ 163B ドル、データセンター向けのエレクトリフィケーション機器受注 2.4B ドルを公表し、これは前年通年を上回ると述べました。ガスタービン関連のバックログとスロット予約は年末までに少なくとも 110GW に達する見通しです。AI の上流受益が「半導体だけでは終わらない」ことを示す、最も明快な一次情報の一つです。

Vertiv は Q1 2026 に売上 2.65B ドル、調整後営業利益率 20.8% を達成し、Americas 売上は強いデータセンター需要で大きく伸びました。同社は別リリースで、AI 向けの極端な高密度化、ギガワット級スケール、適応型液冷が今後の設計を形作ると述べています。Eaton は 1MW 超のラック密度、35MW 級モジュール展開、スイッチギア増産投資を発表し、Schneider Electric は Q1 2026 の Systems 売上 +16%、Energy Management +12.8% の主因としてデータセンターを挙げました。Quanta Services はデータセンター専業ではないものの、Q1 2026 に総バックログ 48.5B ドルの記録を更新しており、送配電・土木・建設のボトルネックが AI の最終段階で見えるようになってきています。

企業・銘柄別整理

下表の「価格転嫁力」と「供給制約」は、公開情報に基づく筆者の 5 点評価です。5 が最も強い水準を意味します。数値そのものは仮説ですが、判断の軸はできるだけ一次情報に置いています。

スコアの考え方:

- 価格転嫁力:需要に対してどれだけ値上げできる余地を持っているか。5 は「需要が強ければ自由に値段を上げられる」(クローズドモデルラボ、HBM 寡占など)、1 は「価格を顧客に押し付けられず、コスト+α でしか取れない」(労働集約的なサービス層など)と読めます。

- 供給制約:需要が増えてから、供給を増やすまでに必要な時間と、物理的な上限。物理層に近いほど高くなります。具体的な目安は以下の通りです。

- 5:fab 建設に 3〜5 年、HBM 認定枠が数年先まで埋まる、ガスタービン EPC が 2〜3 年、施工・許認可で慢性的に逼迫——など、需要が急増しても短期間で供給を出せない構造

- 4:強い制約はあるが、追加投資である程度のスケールアップ余地が残る

- 3:物理的制約はあるが、設備調達や運用で吸収可能

- 2:物理的な上限がほとんどない層(モデルラボ・ソフトウェア層など、自社内に物理制約を持たない)

最も強い投資機会は、この 2 軸の両方が高い場所(HBM、TSMC 先端パッケージ、電力機器など)に生まれやすい、というのが本稿の主張です。

| 企業 | 役割 | 価格転嫁力 | 供給制約 | 主なリスク | 注目KPI |

|---|---|---|---|---|---|

| Anthropic | 高品質クローズドモデル、Agentic/Coding | 5 | 2 | モデル競争、定額制の逆選択、推論費上振れ | ARR、API売上/MTok、出力比率、Enterprise席数 |

| NVIDIA | GPU、ラック、ネットワーク、AIファクトリー | 5 | 3 | 規制、ASIC代替、顧客集中 | Data Center売上、粗利率、Networking attach、Rubin立上り |

| CoreWeave | Neocloud、GPU容量販売 | 3 | 4 | 資金調達、債務、顧客集中 | Revenue backlog、CapEx、利用率、Adjusted operating margin |

| Nebius | Neocloud、Rubin容量 | 3 | 4 | 容量立上り、資金調達、契約履行 | 契約残、稼働開始時期、ARR、設備調達 |

| TSMC | 先端ロジック、CoWoS/SoIC/CoPoS | 4 | 5 | 地政学、CapEx膨張、歩留まり | 先端ノード比率、先端パッケージ能力、GM、CapEx |

| Micron Technology | HBM、SOCAMM、DRAM | 5 | 5 | 需給反転、顧客認定競争 | HBM売上比率、Cloud/Core DC margins、GM |

| Samsung Electronics | HBM4、SOCAMM2、DRAM/NAND | 5 | 5 | 量産歩留まり、労務、価格反転 | DS部門営業利益、HBM4/SOCAMM2量産、受注年限 |

| SK hynix | HBMリーダー、DRAM | 5 | 5 | 顧客集中、競争激化 | HBM比率、営業利益率、供給契約年限 |

| ASML | EUV/DUV露光 | 4 | 5 | 中国規制、顧客CapEx変動 | Bookings、Memory mix、EUV出荷 |

| Applied Materials | 成膜/エッチング/検査、HBM/高度実装 | 4 | 4 | 前工程投資サイクル、中国依存 | Semi equipment growth、HBM/3D packaging売上 |

| Lam Research | エッチ/成膜、TSV/高度実装 | 4 | 4 | メモリ投資反転 | Advanced packaging revenue growth、CSBG |

| KLA | 検査/計測/パッケージ工程管理 | 4 | 4 | 顧客装置投資の時期ズレ | Product/Service成長、Advanced packaging寄与 |

| Tokyo Electron | 前工程装置、HBM工程、3D統合 | 4 | 4 | 中国規制、WFE変動 | 売上、HBM関連POR、先端パッケージ売上 |

| ASE Technology | OSAT、先端パッケージ/テスト | 3 | 4 | TSMC内製比率、価格圧力 | 先端パッケージ売上、テスト比率 |

| Ibiden | ABF/高性能基板 | 4 | 5 | 増産立上り、顧客集中 | CapEx、基板稼働率、層数単価 |

| GE Vernova | タービン、変圧器、グリッド機器 | 4 | 5 | プロジェクト遅延、政策、風力低迷 | Backlog、DC equipment orders、GW slot reservations |

| Vertiv | 冷却・電力・ラック周辺 | 4 | 4 | 競争、効率改善で冷却原単位低下 | 売上成長、Adjusted operating margin、液冷比率 |

| Eaton | 配電・スイッチギア・モジュラー電力 | 4 | 5 | 供給網、工事遅延 | Data center orders、switchgear capacity、prefab lead time |

| Schneider Electric | 配電、冷却、prefab、DCシステム | 4 | 4 | 景気、競争、プロジェクト時期ズレ | EM growth、Systems growth、Data Center mix |

| Quanta Services | 送配電・施工・ユーティリティ接続 | 3 | 5 | 人手、許認可、工事遅延 | Backlog、Electric segment backlog、FCF |

価格決定力とボトルネック比較

下表は、「どこが価格を上げやすいか」と、「どこが物理的に増やしにくいか」を分けて見た比較です。スコアは筆者推定ですが、判断の軸は公開情報に置いています。重要なのは、最強の投資機会は「価格決定力が強い」か「供給制約が強い」かのどちらか一方だけではなく、その両方がある場所に生まれやすい、という点です。

| レイヤー | 価格決定力 | 供給制約 | コメント |

|---|---|---|---|

| クローズド・モデルラボ | 5 | 2 | 高品質エージェントでWTPを取りやすい。ただし物理供給制約は自社より外部依存。 |

| Nvidiaシステム/ラック/ネットワーク | 5 | 3 | システム全体で価格を取りやすい。だが上流制約の影響を受ける。 |

| HBM/SOCAMM/高性能DRAM | 5 | 5 | 2026年の最強利益プールの一つ。価格も供給逼迫も強い。 |

| TSMC先端ノード | 4 | 5 | 価格はじわじわ、供給は急には増えない。 |

| TSMC/OSAT先端パッケージ | 4 | 5 | AIシステム拡張の実質的な物理ボトルネック。 |

| 装置 | 4 | 4 | AI投資の第二波で恩恵。ただし顧客CapExの時差がある。 |

| 基板/OSAT | 3 | 4 | 供給制約は強いが、価格交渉力は前工程よりやや弱い。 |

| Neocloud | 3 | 4 | 超高成長だが、価格決定力は資金調達と供給確保に依存。 |

| 電力/冷却/グリッド機器 | 4 | 5 | 納期と許認可が長く、2026年以降の実質ボトルネック化。 |

| 施工/ユーティリティ接続 | 2 | 5 | 価格決定力は限定的だが、能力不足は慢性化しやすい。 |

時系列で見ると、2025 年までは GPU/HBM/CoWoS 中心の制約でしたが、2026 年以降はHBM と先端パッケージがなお強い一方、グリッド機器・ガスタービン・スイッチギア・液冷・施工へボトルネックが移る可能性が高くなっています。GE Vernova のバックログ急増と、Eaton のスイッチギア増産投資は、その先行指標です。

下表で期間別のボトルネック重心と、その出典を整理します。特に 2026 年の行は SemiAnalysis の主張をそのまま要約しているもので、本稿独自の整理ではありません。一方 2026〜2027 年の行は、GE Vernova・Eaton・Vertiv・Quanta などの一次情報を筆者が時系列に並べた整理です。

| 期間 | 主なボトルネック | 出典・根拠 |

|---|---|---|

| 2023〜2025 | GPU 供給不足、HBM 立上り、CoWoS 不足 | 各社決算・業界周知 |

| 2026 | モデル価値上昇(Agentic AI)、Rubin/SOCAMM でシステム BOM 拡大、HBM・先端パッケージの超過需要継続 | SemiAnalysis「AI Value Capture」の主張をそのまま要約 |

| 2026〜2027 | 電力機器・変圧器・スイッチギアの逼迫、液冷・prefab・施工能力の制約、グリッド接続・ガスタービン納期がボトルネック化 | GE Vernova・Eaton・Vertiv・Quanta の一次情報を筆者が整理 |

反論、追うべきKPI、Open questions

最大の反論は、モデルの差別化が長続きしないのではないかという点です。オープンモデルの改善、ハイパースケーラーの自社 ASIC、企業アプリケーション層での抽象化が進めば、モデルラボや NVIDIA の価格決定力は圧縮されます。NVIDIA 自身も、中国向け製品の在庫・購入義務で 4.5B ドルの費用を計上しており、規制リスクは無視できません。装置側も中国規制や関税、Neocloud 側も資金調達環境が悪化すれば、サイクルは崩れやすくなります。なお、SemiAnalysis 自身は、フロンティア閉鎖モデルが知的労働で明確に優位な間は、計算資源不足と相まってラボの価格決定力は維持される、と見ています。本稿はこの見方に近い立場ですが、確証はありません。

二つ目の反論は、効率改善がインフラ投資を食ってしまうのではないかという点です。これは半分正しく、半分間違っていると思います。Anthropic はモデル改善で同じ仕事をより良くこなせると述べる一方、推論努力レベルの上昇でトークンは増えうると説明しています。Eaton も AI クラスターの「load bursting」という新しい電力品質問題を指摘しており、単純な平均消費電力だけでは測れません。効率の改善はラック数を減らしても、同時に利用量・稼働率・瞬間負荷・運用難度を引き上げます。電力・冷却・ネットワークでは、この「量より質の難しさ」が新しい収益源になります。

三つ目の反論は、冷却株は過熱しており、次世代チップ効率が上がれば需要は鈍るのではないかというものです。実際、Reuters は 2026 年初に Jensen Huang の発言を受けて冷却関連株が下落したと報じています。これは重要な警告で、液冷や高密度冷却に対する期待はすでに株価にかなり織り込まれている可能性があります。ただし、Vertiv はその後も極端な高密度化・液冷の必要性を公式に再確認しており、需要消失というより「必要な冷却の中身が変わる」と見る方が現実的です。

今後追うべき KPI は、はっきりしています。

- モデルラボ:売上/タスク、Enterprise seat 成長、出力トークン比率、長時間エージェント利用の従量化率

- NVIDIA:Data Center 粗利率、Networking 売上、Rubin 立上り、ラック ASP、Spectrum-X 浸透率

- TSMC:先端パッケージ能力、先端ノード売上比率、CapEx の配分、through-cycle margin

- メモリ:HBM の販売枠が何年先まで埋まっているか、HBM4/4E の認定状況、SOCAMM の採用ラック数

- 装置:HBM/高度実装売上の開示、book-to-bill、サービス売上

- 電力:GE Vernova のデータセンター向け受注、タービンスロット予約、Eaton/Schneider の Data Center 寄与、Vertiv の液冷関連成長、Quanta の Electric backlog

Open questions も残ります。Rubin 世代で SOCAMM が NVIDIA の利益率にどこまで効くかは、現時点では外部から厳密に測れません。SemiAnalysis が指摘したSN5610 の Neocloud 向け価格差別化も、一次情報での独立検証は難しい状況です。Anthropic、OpenAI など非上場モデルラボの真の粗利率・顧客維持率・従量課金比率は未開示です。CoWoS/SoIC/CoPoS の正確な月次能力や、HBM/SOCAMM のベンダーシェアも公開が限られます。本稿で最も強く言えるのは、上流の物理制約と公表された利益率改善であり、モデルラボと NVIDIA の「どこまでが価格戦略で、どこまでが需要超過か」の切り分けにはなお不確実性があります。

結論

本稿の答えは、はっきりしています。「Agentic AI がトークンの経済価値を引き上げる → モデルラボのマージンが上がる → NVIDIA がシステム全体でより多くを捕捉する → その価値が TSMC、HBM、先端パッケージ、装置、電力・冷却へ伝わる」という仮説は、2026 年春時点で かなりの程度まで成立し始めている と言えると思います。これはまだ完成したサイクルではありませんが、少なくともメモリ、先端パッケージ、電力の三つでは、すでに一次情報で利益プールの膨張が確認できます。

投資家目線で言い換えると、2026 年の AI テーマは「どの会社が AI 需要に触れているか」ではなく、「どの会社が高価値 AI ワークフローを直接課金できるか、あるいはそれを実現するうえで最も代替しにくい不足資源を握っているか」に移っています。前者はモデルラボと NVIDIA、後者は HBM、先端パッケージ、先端ファウンドリ、そしてグリッド・電力機器・冷却・施工です。Neocloud はその中間にある巨大なオプションですが、財務リスクは最も高くなります。

最後に、2026 年の AI 価値連鎖を一文でまとめるならこうなります。AI は「計算を売る産業」から、「成果の出る仕事を売る産業」へ移りつつあり、価値はその成果を直接値付けできる会社と、その成果を物理的に支える最も不足した層に集中していく。 SemiAnalysis はその最初の半分(モデルラボへの価値シフトと、NVIDIA/TSMC の価値の取り残し)を捉えました。本稿が独自に主張するのは、その後半――メモリ、ウェハ、パッケージ、電力までの上流側への広がり――もすでに始まっている、という点にあります。

出典

一次情報・公開資料

- SemiAnalysis: https://newsletter.semianalysis.com/p/ai-value-capture-the-shift-to-model

- Anthropic Claude pricing: https://platform.claude.com/docs/en/about-claude/pricing

- Anthropic Claude Opus 4.7 release notes: https://www.anthropic.com/news/claude-opus-4-7

- OpenAI Codex: https://openai.com/codex/

- Google Gemini Code Assist: https://docs.cloud.google.com/gemini/docs/codeassist/overview

- NVIDIA Q4/FY2026 results: https://nvidianews.nvidia.com/news/nvidia-announces-financial-results-for-fourth-quarter-and-fiscal-2026

- NVIDIA 10-K: https://www.sec.gov/Archives/edgar/data/1045810/000104581026000021/nvda-20260125.htm

- NVIDIA Spectrum-X: https://www.nvidia.com/en-us/networking/spectrumx/

- TSMC 20-F (2025): https://investor.tsmc.com/sites/ir/sec-filings/2025_20F%20Report.pdf

- TSMC 1Q26 transcript: https://investor.tsmc.com/chinese/encrypt/files/encrypt_file/reports/2026-04/3cef85204275f94fd111485cfdf4adb3c0263c45/TSMC%201Q26%20Transcript.pdf

- Micron FY26 Q2 results: https://investors.micron.com/news-releases/news-release-details/micron-technology-inc-reports-results-second-quarter-fiscal-2026

- Micron data center memory: https://www.micron.com/products/memory/data-center-memory

- Samsung Q1 2026 results: https://news.samsung.com/global/samsung-electronics-announces-first-quarter-2026-results

- Reuters on SK hynix Q1: https://www.reuters.com/world/asia-pacific/nvidia-supplier-sk-hynix-q1-profit-rises-406-meets-forecasts-2026-04-22/

- CoreWeave Q4 2025 results: https://investors.coreweave.com/news/news-details/2026/CoreWeave-Reports-Strong-Fourth-Quarter-and-Fiscal-Year-2025-Results/

- CoreWeave March 2026 investor presentation: https://s205.q4cdn.com/133937190/files/doc_presentations/2026/Mar/02/March-2026-Investor-Presentation.pdf

- Nebius–Meta agreement: https://nebius.com/newsroom/nebius-signs-new-ai-infrastructure-agreement-with-meta

- Reuters on Jane Street / CoreWeave: https://www.reuters.com/legal/transactional/jane-street-signs-6-billion-ai-cloud-deal-with-coreweave-boosts-stake-2026-04-15/

- ASML 2025 annual report: https://www.sec.gov/Archives/edgar/data/937966/000162828026011377/asml-2025xannualxreportx.htm

- Applied Materials investor materials: https://ir.appliedmaterials.com/static-files/8beb86c0-2533-4d20-ba09-41fab41fc451

- Lam Research March-Q26 slides: https://investor.lamresearch.com/image/MarQ26_slides_Full_Final.pdf

- KLA FY2026 Q3 results: https://ir.kla.com/news-events/press-releases/detail/514/kla-corporation-reports-fiscal-2026-third-quarter-results

- KLA on packaging pivot: https://www.kla.com/advance/innovation/the-packaging-pivot-driving-ai-chip-performance

- Tokyo Electron FY26 Q4 transcript: https://www.tel.com/ir/library/report/pjuomj00000000tf-att/fy26q4transcript-e.pdf

- Reuters on ASE: https://www.reuters.com/world/asia-pacific/taiwans-ase-expects-strong-demand-boost-advanced-chip-packaging-sales-2026-2026-04-29/

- Ibiden capital investment: https://www.ibiden.com/company/2026/02/notice-regarding-capital-investment-plan-for-high-performance-ic-package-substrates.html

- GE Vernova Q1 2026 release: https://www.gevernova.com/news/press-releases/ge-vernova-reports-first-quarter-2026-financial

- GE Vernova Q1 2026 webcast: https://www.gevernova.com/sites/default/files/gev_webcast_pressrelease_04222026.pdf

- Vertiv Q1 2026 release: https://investors.vertiv.com/news/news-details/2026/Vertiv-Reports-Strong-First-Quarter-with-Diluted-EPS-Growth-of-136-Adjusted-Diluted-EPS-Growth-of-83-Raises-Full-Year-Guidance/default.aspx

- Vertiv on liquid cooling outlook: https://investors.vertiv.com/news/news-details/2026/Vertiv-Expects-Powering-Up-for-AI-Digital-Twins-and-Adaptive-Liquid-Cooling-to-Shape-Data-Center-Design-and-Operations/default.aspx

- Eaton 2026 data center outlook: https://www.eaton.com/us/en-us/company/news-insights/blog/blog-data-centers-market-outlook-2026-eaton.html

- Eaton modular data center expansion: https://www.eaton.com/us/en-us/company/news-insights/news-releases/2026/eaton-expands-modular-data-center-offering.html

- Eaton Nebraska expansion: https://www.eaton.com/us/en-us/company/news-insights/news-releases/2026/eaton-expands-operations-in-nebraska-with-new-manufacturing-facility.html

- Schneider Electric Q1 2026 release: https://www.se.com/ww/en/assets/pdf/release-q1-revenues-2026

- Schneider Electric IR: https://www.se.com/ww/en/about-us/investor-relations/financial-results/

- Quanta Services Q1 2026 results: https://www.prnewswire.com/news-releases/quanta-services-reports-first-quarter-2026-results-302758147.html

- Reuters on cooling stocks reaction: https://www.reuters.com/business/data-center-cooling-related-stocks-drop-after-nvidia-ceo-huangs-comments-2026-01-06/

内部因果モデル(参考)

- 投資テーマ因果モデル(自前・非公開)— 4 サブグラフ(半導体価値連鎖およびデータセンター電力カスケード)と 18 triple の出典として使用

この記事についてのLinkedIn投稿でコメントや意見を共有できます。

LinkedInで議論する