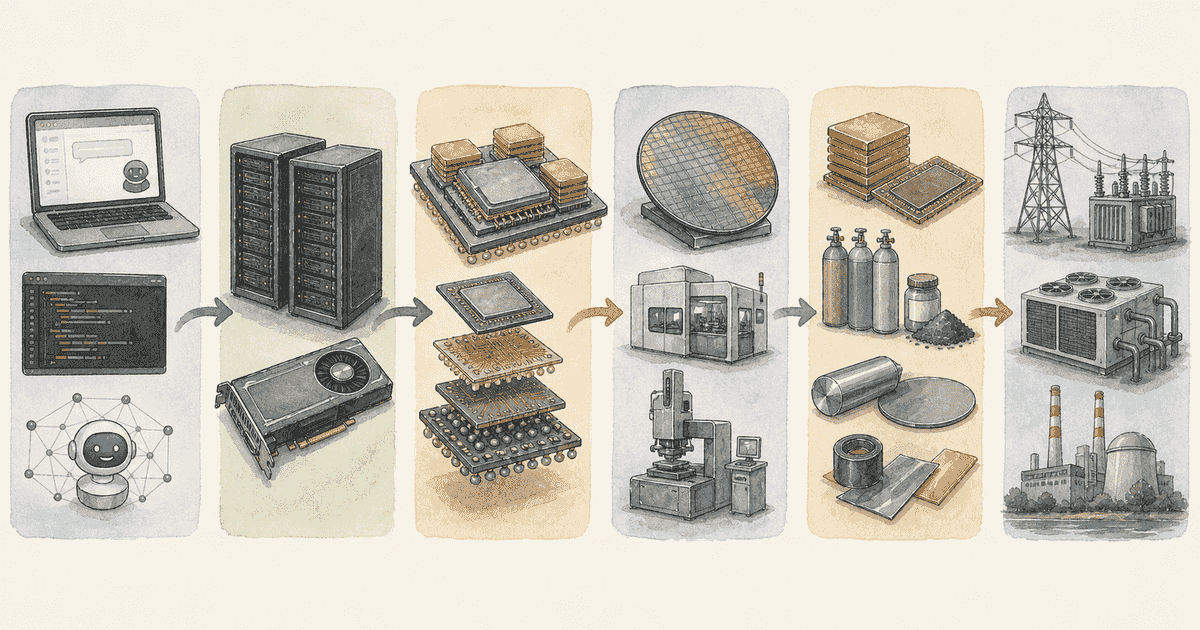

DeepSeek V4のKVキャッシュ90%削減はHBM需要をどう変えるか — 「容量」から「帯域・実装・熱制御」へ

導入:1Mトークンで「KVキャッシュ90%削減」が意味するもの

OpenAIのGPT-5.5やAnthropicのClaude Opus 4.7など、最新世代のモデルが「AIエージェント」として複雑なタスクを自律的にこなすようになり、AIが一度に処理するコンテキストは急速に長大化しています。これに伴い、システム上のメモリ容量や通信帯域の限界、いわゆる「メモリの壁」が現場で大きな課題になっています。

こうした課題への対応として、Googleの「TurboQuant」をはじめとするKVキャッシュ圧縮技術が注目されてきました。なかでもReutersも報じたDeepSeek V4の「100万トークン文脈においてKVキャッシュを90%削減する」という主張は、ソフトウェア側で大幅なメモリ効率化を達成した事例として注目を集めています(公式情報はHugging Faceのモデルページを参照)。

ここで自然に生まれる疑問があります。ソフトウェア側でメモリ消費が大幅に減るなら、これまでAIインフラの主役だったHBM(広帯域メモリ)の需要は減ってしまうのか、というものです。

本稿では、このソフトウェアの進化がハードウェア・サプライチェーンに与える影響を整理します。結論を先に申し上げると、私の視点では、DeepSeek V4のKV圧縮は HBMの需要そのものを失わせるわけではなく、HBMに求められる価値の中身を根本から変える 可能性が高いと考えています。

具体的には、これまでは単純な「データ容量(GB)」が価値の中心でしたが、今後はGPUとの「通信帯域(GB/s)」「I/Oピン密度」、そしてそれを支える「先端パッケージング」「熱制御」「歩留まり管理」へと、価値の重心が移動していくと見ています。

DeepSeek V4が出した数字を整理する

モデルラインナップと圧縮効果

DeepSeek V4は、プレビュー版として2モデルが公開されています。どちらも100万(1M)トークン文脈に対応します。

| 項目 | V4-Pro | V4-Flash |

|---|---|---|

| 総パラメータ | 1.6兆 | 2,840億 |

| アクティブパラメータ | 49B | 13B |

| 文脈長 | 1Mトークン | 1Mトークン |

| 単一トークン推論時のFLOPs(V3.2比) | 27% | 10% |

| KVキャッシュ容量(V3.2比) | 10% | 7% |

DeepSeekは、長文脈処理における最大のボトルネックを「アテンション機構」と見定め、CSA(Compressed Sparse Attention)とHCA(Heavily Compressed Attention)を交互に用いるハイブリッド方式を導入しました。

- CSA:個のトークンごとにKVを1つに圧縮した上で、疎(Sparse)なアテンションを適用します。

- HCA:というより広い範囲のトークンをまとめて1つに重圧縮します。

改善は「1リクエストあたり」の話

ここで重要なのは、これらの改善はあくまで「モデルの推論1回あたり」の効率化だという点です。これがそのまま「データセンター全体のHBM需要が90%減る」ことを意味するわけではありません。事業面では、浮いたHBMの余裕(Headroom)を以下のどこに振り向けるかで、最終的なハードウェア需要は大きく変わります。

- A:同じGPUで、さらに長いコンテキストを処理する

- B:同じ文脈長のまま、同時セッション数(並列度)を増やす

- C:純粋にGPUの設置台数を減らしてコストダウンする

オンディスクKVキャッシュ:階層化メモリ前提のアーキテクチャ

技術的にもう一つ重要なのが、DeepSeekが「オンディスクKVキャッシュ・ストレージ」を明示的にシステムに組み込んだ点です。

複数ユーザーから共通のシステムプロンプト(共有プレフィックス)が要求された際に、プレフィルの再実行を避けるため、圧縮済みのCSA/HCAのKVをSSDに保存 し、ヒット時に再利用する仕組みです。SWA(Sliding Window Attention)の非圧縮KVは圧縮KVの約8倍の容量を食うため、状況に応じて「完全キャッシュ」「定期的なチェックポイント保存」「キャッシュなし」の3モードを使い分けます。

これは、V4が単に「HBMを節約するモデル」ではなく、HBM・SSD・NANDをまたいだ階層化メモリ設計を前提としたアーキテクチャ へと進化していることを意味します。

実装環境:NVIDIAとHuaweiの二面性

実装条件についての公開情報には2つの顔があります。

- 公開スタック(NVIDIA重視):FlashMLA、DeepGEMM、DeepEPなどGitHub上の最適化ツール群は、依然としてNVIDIA GPU(特にHopper/Blackwell)向けに強く最適化されています。

- 実運用(中国国内スタックへの適応):一方でReutersによれば、DeepSeek V4はHuaweiのAscend 950系スーパーノードでフルサポートされ、V4-Flashの学習の一部にもHuaweiチップが使われたとされています。

世界向けに公開しているコードはNVIDIA色が強い一方、本番運用環境では中国国内の代替スタックへの適応が急速に進んでいる、というのが現時点での妥当な見方です。

モデル品質に対する慎重な見方

DeepSeekは長文脈テスト(LongMRCRやCorpusQA)で良好なスコアを示していますが、コーディング・エージェントとしての評価には自社開発の評価フレームワークを使用しています。bash環境とファイル編集ツールのみを使用し、最大512Kコンテキスト・最大500ステップに制限した独自設定で、社内R&D部門が用意した約200の独自タスクや社内ユーザー85人へのアンケートも評価に含まれています。

実用に近い評価ではありますが、第三者による独立検証と比較するとバイアスの余地は残ります。Reutersの報道によれば、V4は画像・動画などのマルチモーダル処理には未対応です。「KV圧縮による効率化は非常に有望だが、品質を完全に維持できているかは第三者検証待ち」というのが、私の視点では最も妥当な評価です。

ソフトウェア効率化がHBM需要をどう動かすか

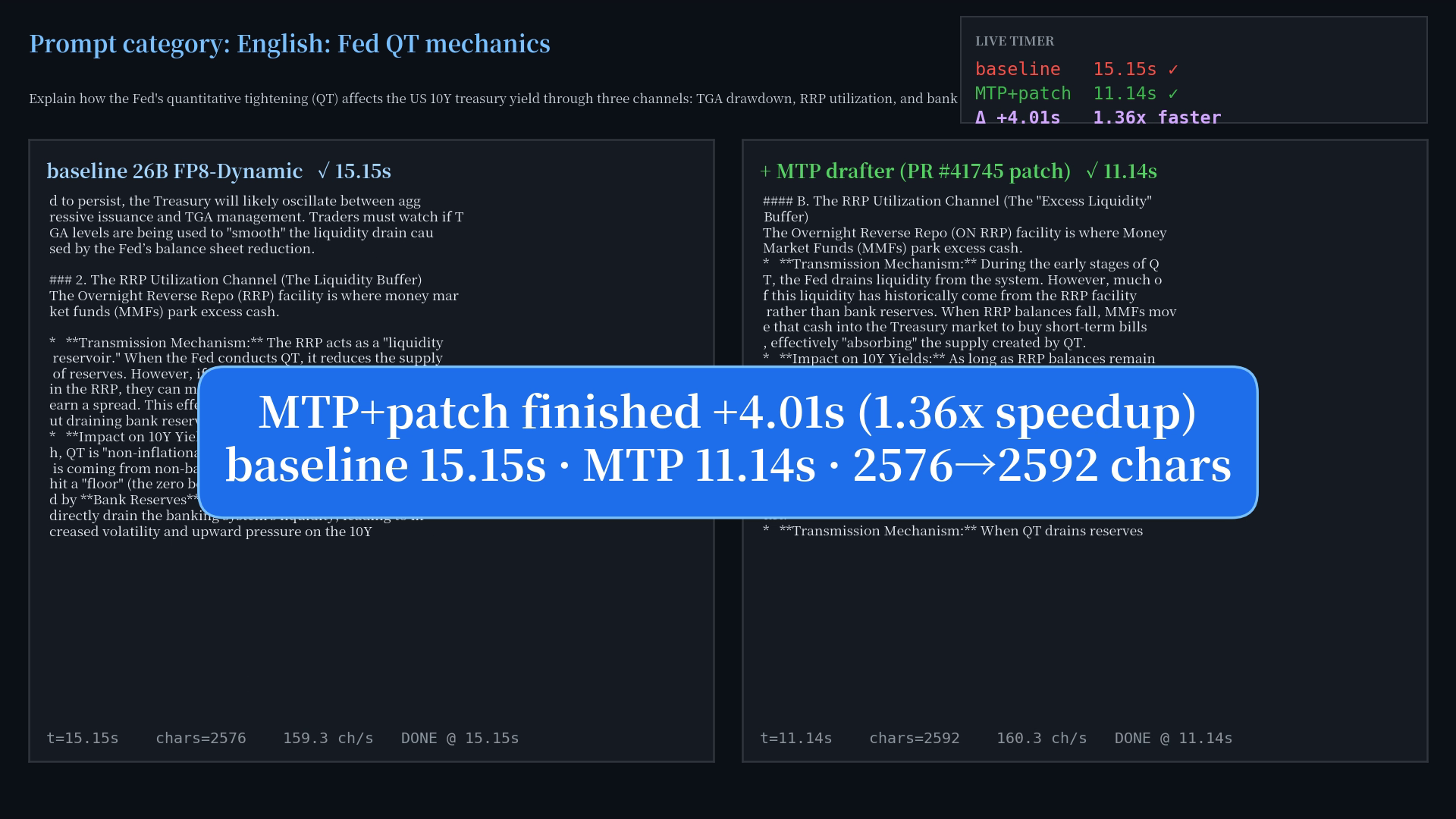

因果ツリー:1つの効率化が需要構造をどう変えるか

DeepSeekのKV削減技術が、どのようにハードウェア市場の需要を動かすかを視覚化したのが下の図です。

flowchart TD

A["DeepSeek V4<br/>KVキャッシュ大幅圧縮"]

B["1リクエスト当たり<br/>KV容量 ↓"]

C["アテンション FLOPs ↓"]

D["同HBMで長文脈処理"]

E["同HBMで高並列処理"]

F["容量単独のプレミアム ↓"]

G["長文脈推論の単価 ↓"]

H["Agentic / RAG / 1M文脈<br/>の採算性が改善"]

I(("推論総量が<br/>爆発的に増加"))

J["HBMの価値が<br/>帯域・熱・実装へ移動"]

K["HBM4 / TSV / インターポーザ<br/>CoWoS = 真のボトルネック"]

L["SSD / CXL / HBF への波及"]

M["容量負担を下位メモリが補完"]

A --> B

A --> C

B --> D

B --> E

B --> F

C --> G

D --> H

E --> H

G --> H

H --> I

F --> J

J --> K

B --> L

L --> M

classDef primary fill:#e1f5fe,stroke:#0288d1,stroke-width:2px;

classDef secondary fill:#f3e5f5,stroke:#8e24aa;

classDef bottleneck fill:#ffebee,stroke:#c62828,stroke-width:2px;

class A primary;

class B,C,D,E,F,G,L,M secondary;

class H,I primary;

class J,K bottleneck;ポイントは、図の右側で HBMの価値が「帯域・熱・実装」に移っていく流れ と、下側で オンディスクKV経由で下位メモリ階層に需要が波及する流れ が同時に走っていることです。

メモリ階層全体の再編

DeepSeekの設計思想は、HBM単体での最適化ではなく、メモリ階層全体での役割分担を前提にしています。

flowchart TD

GPU["GPU<br/>計算"]

HBM["HBM<br/>容量 × 帯域"]

CXL["CXL DRAM<br/>Warm層"]

HBF["HBF<br/>容量 8〜16倍"]

SSD["SSD / NAND<br/>オンディスクKV"]

GPU <==>|TB/s| HBM

HBM <-->|プール| CXL

HBM <-->|Tier 2| HBF

HBM -.->|オーバーフロー| SSD

classDef hot fill:#ffe0e0,stroke:#c62828,stroke-width:2px;

classDef warm fill:#fff8e0,stroke:#f57c00;

classDef cold fill:#e0f2f1,stroke:#00796b;

class GPU,HBM hot;

class CXL,HBF warm;

class SSD cold;HBMが頂点(Hot)にあるのは変わりませんが、その下に CXL DRAM・HBF・SSD という Warm/Cold の階層が生まれ、KVキャッシュの種類や利用頻度に応じてデータが流れる構造へと向かっています。これは「HBMの死」ではなく、HBMを頂点としたメモリ階層全体の再編 と捉えるべきです。

5つの主要な結論

ここまでの整理を踏まえ、以下5点に集約できます。

- 【短期】 KV圧縮は「1リクエストあたりのHBM容量需要」を確実に下げます。ただし、2026年の実市場ではHBM本体と先端実装の供給が逼迫しているため、すぐに全体需要が壊れるわけではありません。

- 【中期】 メモリの価値は「1スタックあたり容量(GB/stack)」から「通信帯域・I/O・TSV・インターポーザ・アンダーフィル・熱制御・歩留まり」へとシフトします。HBM4と先端パッケージングの重要性がさらに増します。

- 【長期】 HBF・CXL・オンディスクKV・ニアメモリコンピューティングが普及します。ただしこれらはHBMを置き換えるのではなく、HBMの下位の容量階層を担う方向で進む可能性が高いです。

- 【最大の勝者】 メモリメーカー単体ではなく、その周辺にある 先端パッケージング・基板材料・計測検査装置・熱対策・素材メーカー が最大の恩恵を受けると見ています。

- 【不確定要素】 最大のリスクはDeepSeek V4の性能が独立機関で再現・検証されるかという点と、KV圧縮による単価低下が「需要の爆発」に十分転化するかどうかです。

推論と学習の経済性

推論への直接的な効果

推論フェーズでは、KVキャッシュ削減の効果は比較的ダイレクトに現れます。デコーダー専用LLMが文章を生成する際、各トークンの処理ごとに「モデル重みの読み出し」に加えて「過去の会話履歴(KVキャッシュ)の読み出し」が発生します。文脈が長くなるほど、KVの容量とデータ転送量の負荷が雪だるま式に増大します。

DeepSeek V4はこの読み出し部分と計算部分を大きく削ぎ落としました。NVIDIA H200のような大容量HBM搭載GPUでは、浮いたリソース(Headroom)を「より大規模な並列処理(バッチサイズ拡大)」「より長いコンテキスト処理」「より高速なトークン生成」へと再配分しやすくなります。

実際の市場では、NVIDIAはH200の価値を「141GBのHBM3eと、4.8TB/sの超広帯域」に置いており、Micronも自社のHBM3E(24GB/36GB)について「1.2TB/s以上の帯域」「処理クエリ数が50%増加する」と訴求しています。実需は依然として HBMの物理的な存在量と通信速度 に価値を見出していることが分かります。

学習領域での限界

一方で、モデルの学習フェーズでは状況が異なります。学習時にメモリを消費する主要因は「パラメータ」「勾配」「オプティマイザ状態」「アクティベーション」の4つで、DeepSeek自身も学習フレームワークではコンテキスト並列化やテンソルレベルのチェックポイント技術で対応しています。

V4のKV圧縮は、学習時の長文脈通信効率化には役立つものの、学習工程そのものを「HBM不要」にするわけではありません。学習において、HBMの大容量と高帯域は今後もシステムの中核であり続けます。

コスト削減効果の試算(筆者モデル)

クラスタ運用者にとっての実質的なコスト削減効果(TCO)を、単純化したモデルで試算してみます。

- 推論にかかる全体時間のうち、KVキャッシュに起因する負荷の割合を とします。

- DeepSeekの主張通り、KV関連のデータ量を90%削減できると仮定します。

- この場合、レイテンシ改善幅は概ね と近似できます。

実際のワークロードに当てはめると、以下のようになります。

| ワークロード | KV負荷比率 (推定) | レイテンシ改善幅(≈) |

|---|---|---|

| 短文脈チャット | 10–20% | 9–18% |

| 長文脈RAG・エージェント | 30–60% | 27–54% |

ワークロード別のボトルネックとHBM需要への影響

| ワークロードの種類 | システムの典型的なボトルネック | KV圧縮の恩恵 | HBM需要への一次的影響 | コメント |

|---|---|---|---|---|

| 短文脈チャット | モデル重み読み出し、低並列でのデコード処理 | 小〜中 | やや弱気〜中立 | KV比率が低いためHBM削減効果は限定的。コスト削減より同時セッション数の増加に振られやすい |

| 長文脈RAG | KV容量不足、KV転送帯域、プレフィル/デコードの負荷不均衡 | 大 | 中立〜強気 | 1M文脈や巨大プロンプト再利用が採算に乗りやすくなり、推論総量が拡大しやすい |

| Agenticタスク(コーディング等) | 長文脈 + 多段階ツール呼び出し + 共有プレフィックス | 大 | 強気 | 1タスクあたりトークン消費が桁違いに大きく、単価低下がそのまま需要増に直結しやすい |

| 事前学習・大規模RL | アクティベーション、勾配、オプティマイザ状態、メモリ帯域 | 小 | 中立 | 学習ではKV圧縮の効果は補助的。大容量HBMが依然として絶対的な主役 |

重要な洞察は、DeepSeek V4の成功は 「HBMの総量を減らすこと」よりも「HBMの使われ方を変える力学」として働く という点です。NVIDIA GB200 NVL72やBlackwell Ultraといった最新アーキテクチャは、「兆規模のリアルタイム推論」や「自律型AI」を、NVLinkによる高速結合・高帯域メモリ・水冷システムで支える設計を前面に押し出しています。モデルが賢くなってKVが圧縮されても、データセンターの設計思想は「余ったHBMを取り外してコストを下げる」方向ではなく、「余った処理能力を使って、これまで不可能だった高度なタスクを回す」方向 に向かいやすい、というのが私の見立てです。

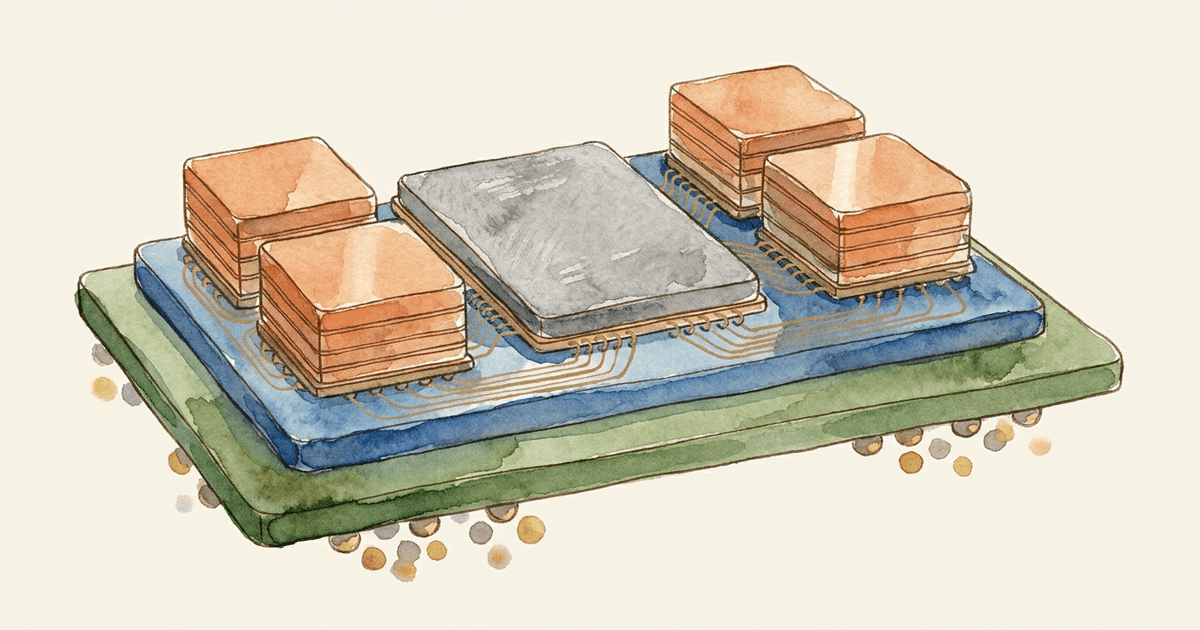

HBMの機能分解:価値はどこに移るか

HBMの真の価値を見極めるには、単なる「容量の大きいメモリ」という認識を捨て、「容量・帯域幅・I/Oピン・積層・実装・熱制御・歩留まり」が極限レベルで融合した複合製品として分解する必要があります。

各社の最新製品仕様を見ても、それは明らかです。

| メーカー | 製品 | 容量 | 帯域 | 通信ピン |

|---|---|---|---|---|

| Samsung HBM4 | HBM4 | 36GB | 最大3,300GB/s | 2,048 I/O・最大13Gbps |

| Micron HBM3E | HBM3E | 24GB / 36GB | 1.2TB/s以上 | — |

製品訴求の中心は「容量(GB/stack)」だけではなく、「圧倒的な通信速度(GB/s/stack)」へと明確にシフトしています。

HBMはメモリチップ単体では動かない

さらに重要なのは、HBMはDRAMチップだけでは機能しない、という点です。TSMCのCoWoS-Sは、HBMキューブをロジックダイと共に巨大なシリコンインターポーザ上に配置し、極小の配線でつなぎ合わせる工程を担います。Applied Materialsによれば、HBMの製造には通常のDRAM製造に比べて約19もの追加の材料工学ステップが必要であり、TSV・バリア/シード層・マイクロバンプ・チップの反り(Warpage)制御が不可欠です。

熱設計の観点でも、HBMを12層以上積み重ねると熱抵抗が急激に上昇するという物理的な壁が存在し、特殊な封止材(MR-MUF)や放熱材(ヒートスプレッダ)が命運を握ります。

HBMの真のBOM(部品表)は、下図のような複合スタックとして捉えるのが正確です。

flowchart TB

subgraph S1["HBMスタック内部"]

DRAM["DRAMダイ × 12〜16層"]

BASE["ベースダイ"]

TSV["TSV<br/>シリコン貫通電極"]

BUMP["マイクロバンプ"]

UF["アンダーフィル<br/>MR-MUF / NCF"]

end

subgraph S2["パッケージング"]

INT["シリコンインターポーザ"]

SUB["ABF基板"]

end

subgraph S3["熱制御"]

TIM["TIM"]

LID["ヒートスプレッダ"]

COOL["水冷モジュール"]

end

DRAM --> TSV

BASE --> TSV

TSV --> BUMP

BUMP --> UF

UF --> INT

INT --> SUB

SUB --> TIM

TIM --> LID

LID --> COOL

classDef inner fill:#e3f2fd,stroke:#1976d2;

classDef pkg fill:#fff3e0,stroke:#e65100,stroke-width:2px;

classDef thermal fill:#ffebee,stroke:#c62828;

class DRAM,BASE,TSV,BUMP,UF inner;

class INT,SUB pkg;

class TIM,LID,COOL thermal;HBM周辺インフラと、KV圧縮への感応度

| 物理階層 | 主要部品 | 製造工程・材料 | 上流原材料 | KV圧縮への感応度 |

|---|---|---|---|---|

| DRAMスタック | 複数のDRAMダイ + ベースダイ | 高度なシリコンプロセス、積層高制御、ロジック統合ベースダイ | 高純度シリコンウェハ、前工程材料群 | 容量軸の価値はやや低下。学習や超高帯域推論では依然として中核 |

| TSV(シリコン貫通電極) | チップを垂直に貫通する微細配線 | 絶縁ライナー、バリア層、シード層、Cuめっき、CMP | 酸化膜ライナー、TiN/WNバリア、Cuシード/充填、CMPスラリー | 上昇。HBM4以降、I/O数の激増・微細化で重要性が跳ね上がる |

| マイクロバンプ / ピラー | ダイ間の極小接点 | UBM、接合面洗浄、微細バンプ形成 | Cu系配線、Sn/Ag接合材 | 上昇。容量より「チップ間接続密度」が価値の源泉に |

| アンダーフィル / 封止材 | MR-MUF、NCF、EMC | 発熱・応力の緩和、Warpage防止 | エポキシ系樹脂、シリカ等の無機フィラー | 上昇。高速通信と多段積層化で熱・応力制御が最大の制約 |

| シリコンインターポーザ | GPUとHBMの中間基板 | RDL、TSV、裏面金属化 | シリコンウェハ、Cu配線、CMP関連 | 上昇。CoWoS等2.5D実装で大型化が歩留まり制約に |

| パッケージ基板(ABF) | ビルドアップ基板 | 微細配線、多層化 | エポキシ樹脂 + 硬化剤 + 無機フィラー、PET支持フィルム | 上昇。味の素ABFが事実上の独占で、大面積化・高層化が難易度を押し上げる |

| 熱制御スタック | TIM、リッド、水冷モジュール | チップ間界面熱抵抗の低減、熱拡散 | アルミナ、窒化ホウ素等の高度熱伝導材料、冷却機構 | 上昇。ラック単位の推論サーバー化と水冷標準化で付加価値が急増 |

KV圧縮によってHBMの「容量効率」が向上すればするほど、相対的に「微細な配線をどう引くか」「反りをどう抑え込むか」「発生する熱をどう逃がすか」という実装・基板側の課題に価値(=利益の源泉)が移転していく、というのが本稿の中核的な投資仮説です。

シナリオ分析と勝者・敗者

3つのシナリオ

KV圧縮で浮いたリソースが「何に使われるか」によって、需要シナリオは大きく3つに分かれます。

flowchart TD

A["KV圧縮で余った<br/>HBMリソース"]

A --> B{"何に使われるか"}

B -->|コスト削減に全振り| W["弱気シナリオ<br/>確率: 低〜中"]

B -->|長文脈・並列・RPS増| N["中立シナリオ<br/>確率: 中〜高"]

B -->|Agentic AI需要爆発| S["強気シナリオ<br/>確率: 中"]

W --> W1["GPU容量 ↓<br/>大容量プレミアム剥落"]

N --> N1["HBM4 / CoWoS / 帯域<br/>がボトルネック"]

S --> S1["HBM + HBF + CXL<br/>が同時拡大"]

classDef bear fill:#ffe0e0,stroke:#c62828;

classDef base fill:#fff8e0,stroke:#f57c00,stroke-width:2px;

classDef bull fill:#e0f2f1,stroke:#00796b;

class W,W1 bear;

class N,N1 base;

class S,S1 bull;弱気シナリオ(発生確率:低〜中)

ハイパースケーラーがKV圧縮で浮いたリソースを純粋に「GPUやHBMの搭載数削減」に全振りするケースです。短文脈中心で推論量自体が伸び悩む市場では、GPU1基あたりの必要HBM容量が下がり、24GBや36GBのスタックで足りる案件が増えます。大容量プレミアムは剥落しますが、それでも帯域・実装・熱の技術的ハードルは残るため、先端パッケージのメーカーは敗者になりません。

中立シナリオ:ベースケース(発生確率:中〜高)

大容量自体への需要はやや落ち着くものの、空いたリソースを使って 同じHBM環境で「長文脈」「高並列化」「秒間リクエスト数の劇的増加」を処理する 方向に向かい、HBM全体のTAMは崩れません。このシナリオの真の勝者は、容量勝負のメモリメーカーではなく、HBM4・高速ピン技術・CoWoS・微細検査・歩留まり管理・液冷素材を提供する企業群です。NVIDIAが最新アーキテクチャでAgentic AIを強くプッシュしている現状は、まさにこの軌道上にあります。

強気シナリオ(発生確率:中)

KV圧縮によるコスト低下が、現状維持ではなく「全く新しい需要(需要曲線の右シフト)」を創出するケースです。1M文脈処理が低コストで可能になれば、これまで採算が合わなかった「長期間稼働する自律型エージェント」「企業内の全社ドキュメント横断検索」「高度なコーディング支援」が日常的に使われるようになります。1タスクあたりのトークン消費が爆発し、クラスタ全体の需要はむしろ激増します。HBFやCXLが下支えとして伸びますが、頂点のHBMは絶対的インフラとして機能し続けます。

サプライチェーン各層への波及効果

| 業界の階層 | 主要プレイヤー | 現在の役割 | KV圧縮による影響 | 業界が抱える真のボトルネック |

|---|---|---|---|---|

| メモリ本体 | SK hynix、Samsung、Micron | HBM3E / HBM4スタックの製造・供給 | 容量プレミアムは相対的に低下。ただし推論総量の爆発で全体需要は維持〜拡大 | 先端DRAMの歩留まり、12〜16層の高層スタック化、ベースダイの高度化 |

| ファウンドリ / パッケージング | TSMC、Amkor、ASE | インターポーザ製造、2.5D/3D統合実装、最終テスト | 構造的な追い風。メモリ通信の複雑化が実装の付加価値を高める | CoWoS/3D-ICのキャパ不足、大型化に伴う歩留まり低下、長い工期 |

| 製造・検査装置 | Applied Materials、KLA、Lam Research | TSV形成、成膜、エッチング、検査、反り制御 | 追い風。実装難易度の上昇が最新装置への投資を強制 | TSVの微細化、欠陥制御、ハイブリッド接合の成熟化 |

| パッケージ素材 | 味の素(ABF)、各種アンダーフィル材メーカー | 高密度基板の絶縁、チップ間接続部の熱応力緩和 | 追い風。熱と応力の制御がシステムの命綱に | 寡占企業への供給集中、Qualリードタイムの長さ |

| 代替(下位)メモリ階層 | Sandisk(HBF)、CXLエコシステム | HBMを補完し、あふれたデータを安価に保存する下位の容量層 | 最大の追い風。DeepSeek型アーキテクチャと完全に合致 | ソフトウェア統合、実効レイテンシ短縮、業界標準化の速度 |

2026年時点でも、最大のボトルネックは「HBMチップそのものの増産」というより、「完成したHBMをGPUと組み合わせて出荷するための先端パッケージング能力」にある、という点は強調しておきたいところです。TSMCはアリゾナでのCoWoS新工場立ち上げを急ぎ、ASEも先端パッケージング事業の売上倍増を見込んでいます。

代替テクノロジーとの相互作用

HBM以外のメモリ技術との力学を見ると、中立〜強気シナリオがさらに裏付けられます。

- HBF(High Bandwidth Flash):SandiskとSK hynixが標準化を進めるHBFは、HBM並みの帯域を持ちつつ8〜16倍の容量を備えることを目標としています。これはオンディスクKV保存の需要と完璧に噛み合い、HBMを駆逐する敵ではなく、容量不足を安価に補完する強力な味方として機能します。

- CXL:CXLによるメモリプーリングは、複数ホスト間でメモリを動的に割り当てます。KV圧縮の世界では、最高速で高価なHBMを「データを置いておくだけの容量」として贅沢に使う必要性が薄れ、CXL DRAMという中間層(Warm tier)に逃がす設計が合理的になります。

- GDDR7:中価格帯(Mid-tier)の推論用途では、相対的価値が上がります。HBMほどの帯域密度や電力効率はありませんが、KV圧縮で「超ハイエンドなHBMでなくても十分に推論が回る」領域が広がるため、TCO観点での再評価が進む可能性があります。ただし最先端の大規模推論の主役の座は奪えません。

- ニアメモリ・コンピュート / HBM-PIM / ハイブリッド接合:これらの価値はむしろ高まります。SamsungのHBM-PIMや、Applied Materialsが推進するハイブリッド接合は、物理的な「データ移動の負荷」を削減します。容量問題が緩和されても、データ高速移動時の「熱と電力消費」という物理的課題は消えないため、これらへの投資価値は揺るぎません。

投資と事業戦略への示唆

| プレイヤーの立場 | 勝敗の方向感 | 主要な論点 | 追うべきKPI |

|---|---|---|---|

| 勝者候補(Tier 1) | HBM4寄りの高付加価値メモリ、先端実装、微細検査、熱制御素材、基板材料 | 大容量より「帯域・実装密度・熱設計」が価格プレミアムの源泉 | HBM4の売上構成比、ピン通信速度、CoWoS等の先端実装ライン稼働率 |

| 勝者候補(Tier 2) | CXL / HBF / 高速SSDによる階層化インフラ | DeepSeekが提示した階層型メモリ設計と相性が完璧 | プレフィックス・キャッシュのヒット率、SSDのRead amplification、CXLプール導入数 |

| 中立〜勝者 | GDDR7関連エコシステム | HBM外のミドルレンジ推論市場でTCO勝負 | 推論用GPUにおけるHBM搭載SKUとGDDR搭載SKUの販売比率 |

| 相対的に弱い立場 | 「容量の大きさ」だけで差別化を図ろうとするHBM製品 | 「ただ容量が大きいだけ」のプレミアムは剥がれる危険性が高い | GPU1基あたりHBM容量の伸びが鈍化する兆候 |

追跡すべきKPIチェックリスト

- メモリベンダー(SK hynix等)から「需要が生産能力を上回っている」という強いガイダンスが継続して発信されているか

- 新型GPUのアピールポイントが、「何GB積んでいるか」から「通信帯域・I/O性能・水冷対応・ラック全体での推論性能」へ完全に移行しているか

- TSMC・Amkor・ASEなどファウンドリ・OSATによる、CoWoSや3D-IC等「先端実装工程」への巨額な設備投資(Capex)が継続しているか

- 現場のAI運用において、「1タスクあたりの消費トークン数」「平均コンテキスト長」「ツール呼び出し回数」が明確に拡大しているか(効率化が需要拡大に転化しているかのリトマス試験紙)

留意事項

- 現時点では、DeepSeek V4の長文脈品質に関する第三者の独立した検証が不十分です。

- 公開されているコードは末端の通信層にとどまり、DeepSeekが本番環境で動かしているシステムスタックの実態はブラックボックスです。

- 本稿の最も強固な結論は「HBMが不要になる」ことではなく、「HBMに求められる価値基準が、容量主導から帯域・実装・熱設計主導へと完全にシフトする」という構造変化の指摘にあります。

出典

- DeepSeek-V4-Pro モデルカード(Hugging Face)

- Reuters:China’s DeepSeek returns with new model

- Reuters:DeepSeek V4 adapted to Huawei chips

- DeepSeek FlashMLA / DeepGEMM / DeepEP

- Samsung HBM / Micron HBM3E

- NVIDIA H200 / NVIDIA GB200 NVL72

- TSMC CoWoS

- Applied Materials:HBM materials innovation

- Applied Materials:Hybrid bonding

- KLA Advanced Packaging

- 味の素ABF

- CXL:Memory Pooling and Sharing

- Sandisk × SK hynix:HBF standardization

- Reuters:SK hynix Q1 results

- Reuters:TSMC Arizona packaging plant

- Reuters:ASE advanced packaging

- Amkor 2.5D/3D TSV

この記事についてのLinkedIn投稿でコメントや意見を共有できます。

LinkedInで議論する