マルチAIエージェントが動かす新しい世界 ― AIが互いにレビューし、補完し、交渉しながら価値を生む時代へ

AIエージェントの議論というと、つい「人間の仕事をどこまで代替するか」という話に寄りがちです。 ただ、ここ数日のニュースを見ていると、もう少し別の変化が見えてきます。

それは、AIが人間の指示を待って単発で動く段階から、複数のAIが同時に動き、互いに監視し、補完し、場合によっては交渉まで行う段階へ進みつつあるということです。

しかもその変化は、モデルそのものだけでなく、決済、セキュリティ、オーケストレーション、コンテキスト管理といった周辺レイヤーまで含めて起きています。

私が今回面白いと思うのは、これが単なる「AIツールの高機能化」では終わらない可能性があることです。 突き詰めると、AI同士の相互作用そのものが新しい価値を生む世界に近づいているのではないか、というのが今回の主張です。

参考となるニュース

1. AIエージェント向け決済の規格づくりは、すでに始まっている

前回の記事でも書いた通り、AIエージェントが自律的に少額決済するための土台として、HTTP 402、x402、MPPといった仕組みが現実の実装フェーズに入り始めています。CloudflareはAgentic Paymentsとしてx402とMPPの両方を扱い、StripeはMPPを公開しています。

詳細は前回の記事「ビットコインの次に来る仮想通貨 — AIエージェント時代の金融インフラ覇権争い」、およびCloudflare の x402 Foundation 発表とStripe の Machine Payments Protocolを参照してください。

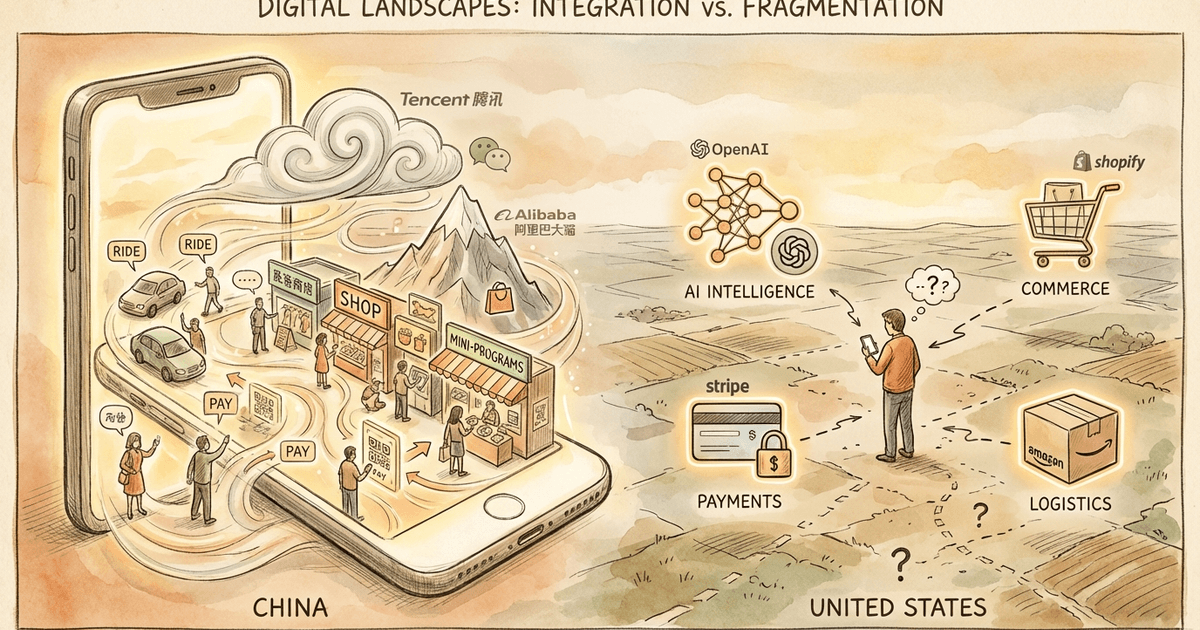

ここで重要なのは、AIにとっての決済が「人間向けUIを経由した支払い」ではなく、エージェント同士がプログラムとしてやり取りする土台作りへと移行していることです。

2. モデルは一つを極めるより、複数を使い分ける方向へ進んでいる

OpenRouterは単一APIで300以上のモデルへアクセスし、タスクごとに最適なモデルを選ぶことができるサービスで、単一のAIモデルに依存するのではなく、タスクに応じて複数のモデルを使い分ける手法が主流になりつつあります。

MicrosoftのCopilotが「OpenAIのモデルで調査し、Anthropicのモデルで内容をダブルチェックする」機能をリリースしたことは、このトレンドの象徴です。

The Information の報道では、開発者がAIモデルを選ぶのを助けるスタートアップが13億ドル規模の評価額に近づいていると伝えられています。

またMicrosoftもOpenAI系とAnthropic系を役割分担させる使い方を進めており、マルチモデル運用そのものが一つのトレンドになっています(Codex and Claude Code Can Work Together — The Information)。

これは単なるコスト最適化ではなく、

- あるモデルは計画に強い

- あるモデルは大量実装に強い

- あるモデルはレビューや検証に強い

という具合に、役割分担されたAI編成が前提になり始めている、ということでもあります。

3. Claude Code と Codex は、競争しながらも共存し始めている

添付資料によれば、OpenAIはClaude Codeの中でCodexを使えるプラグインを公開し、Cursorも複数のコーディングエージェントを同時に扱う方向へ進んでいます(OpenAI: Introducing the Codex app、新しいCursorのご紹介)。

実際に、片方が書いたコードをもう片方にレビューさせる使い方が広がっているとされています。

ここで見逃せないのは、AIがAIの成果物をチェックする構図が、すでに現場レベルで始まっていることです。

4. proactive な常駐型エージェントへの進化も進んでいる

Claude Codeの次世代モデルのソースコードの流出が、世間を騒がせています(Claude’s code: Anthropic leaks source code for AI software engineering tool — The Guardian)。

Claude Codeの流出した資料では、Kairosという機能群として、バックグラウンド実行、Dream Modeによる記憶の統合、proactive な振る舞いなどが示されていました。これは、AIが単なる対話UIではなく、常駐し、自ら進捗し、文脈を維持しながら動く存在へ進化しようとしていることを意味します(Anthropic ‘Mythos’ Model Signals New Era of AI Cybersecurity Risks — The Information)。

この方向性は、ユーザーのPC上で複数モデルを動かしやすいOpenClaw的な発想ともかなり近いです。

5. セキュリティは「AIを使うかどうか」ではなく「AIでAIを守るかどうか」の段階に入っている

上述した流出した資料では、Anthropicの次世代モデルMythosがサイバーセキュリティ領域で極めて強い能力を持つ可能性が示されています。

また、サイバーセキュリティ企業のWizなどの防御側もAIで脆弱性を先回りして見つけ、パッチを当てる競争に入っていると報道されています。

さらに、ガーディアンAIという形で、他のAIエージェントの逸脱行動を監視・停止する仕組みも立ち上がり始めています。

つまり、セキュリティもまた、人間がルールを決めて監視する世界から、AI同士が攻防を繰り返す世界へ入りつつあります。

Generative Adversarial Networks (GAN)について

私は、この流れを見ていて、古典的なGenerative Adversarial Networks (GAN)の発想を思い出しました。 GANは「敵対的生成ネットワーク」と呼ばれる仕組みで、考え方は下記となります。

登場するのは、主に次の2役です。

- Generator(生成側) 偽物でもよいので、とにかくそれらしいものを作る役

- Discriminator(判定側) それが本物らしいか、どこが不自然かを見抜く役

たとえば、偽物の絵を描く人と、それを見て「どこが変か」を見抜く審査員がいると考えると分かりやすいです。

最初は、絵を描く側も下手ですし、見抜く側もそれほど優秀ではありません。 しかし、

- Generator が何かを作る

- Discriminator が「ここが変だ」と見抜く

- Generator がその指摘を踏まえてもっと上手に作る

- Discriminator もさらに見抜く力を上げる

というやり取りを何度も繰り返すことで、両者がだんだん賢くなっていきます。

つまりGANの本質は、一つのAIが単独で賢くなるのではなく、二つの役割が競い合うことで精度を高めていくことにあります。

GANはもともと、画像生成の文脈でよく知られました。 たとえば「本物の人間の顔に見える画像」を作る用途です。

- Generator は本物っぽい顔画像を作ろうとする

- Discriminator はそれが本物の写真か、AIが作った偽物かを見抜こうとする

この勝負を繰り返すことで、だんだん本物に近い画像が作られるようになります。

ただ、私が今回重要だと思うのは、GANを「画像生成の一昔前の技術」として見ることではありません。 むしろ、役割の違うAI同士をぶつけることで、単体モデルでは出にくい改善を引き出す手法として見ることです。

GANそのものではないが、発想としては近い

ここで補足すると、私が言いたいのは、異なるAI同士をぶつける仕組みが厳密な意味でGANそのものだということではありません。

本来のGANは、Generator と Discriminator が明確な目的関数のもとで競い合いながら、Generator と Discriminator を同時最適化する学習手法です。 一方で、ここで述べているAI同士のやり取りは、複数のモデルやエージェントが役割分担し、相互にレビューや修正を繰り返す運用上の仕組みです。

したがって、両者は同じものではありません。 ただ、「生成する側」と「それを検証・批判する側」を分け、相互作用によって全体の精度を高めていくという意味では、GAN的な発想に通じる部分があります。

私が面白いと思うのは、GANという古典的な考え方のエッセンスが、AIエージェント時代には「画像生成モデルの学習手法」としてではなく、複数AIの役割分担と反復改善の設計思想として再登場しているように見えることです。

現在のAIモデル・AIエージェントの世界にこの発想を当てはめると、かなり分かりやすくなります。

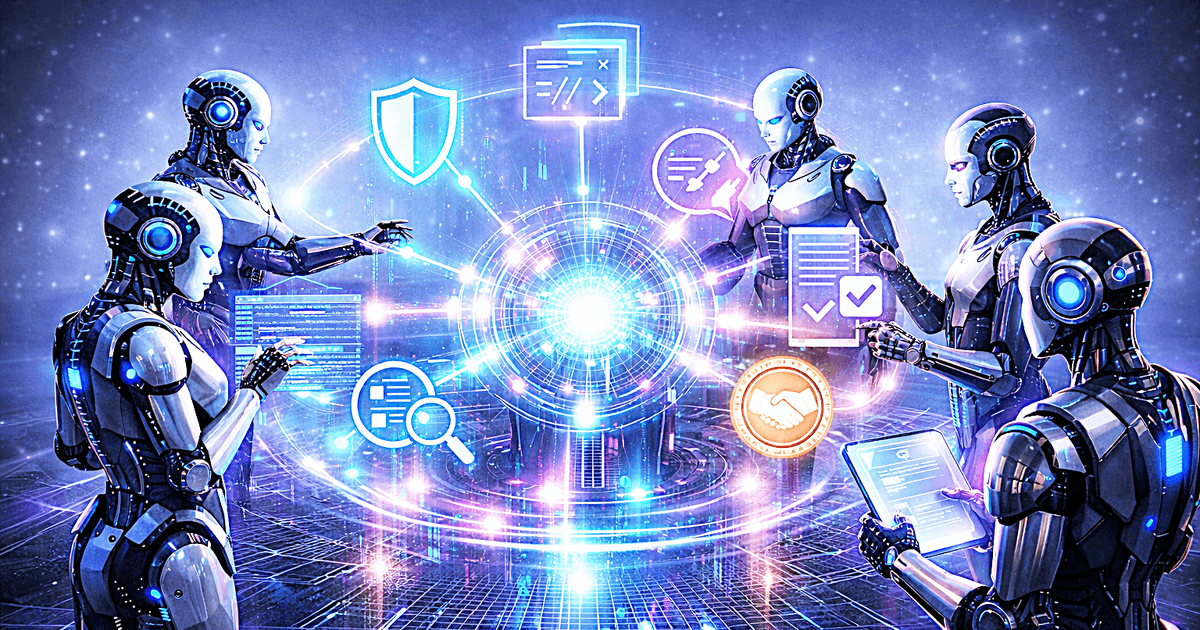

たとえばソフトウェア開発やセキュリティなら、

- 一方のAIがコードを書く、パッチを作る、対策案を出す

- もう一方のAIがそのコードを監査し、バグや脆弱性や見落としを指摘する

- さらに最初のAIが修正版を出す

- 再びもう一方がレビューする

というループができます。

これをGANにたとえるなら、

- Generator = コードや対策案を生み出す側

- Discriminator = その欠点を見つけて評価する側

です。

もちろん、今のAIモデル・AIエージェントがGANの数学的に定義された役割とは異なりますが、 ただ、生成する役と、見破る役を分けて、相互作用させながら改善していくという意味では、かなり近い発想です。

なぜこの構図が重要なのか

ここで大事なのは、単体のAIモデルには限界があることです。

どんなに強いモデルでも、

- 自分で書いたコードの欠点を見落とす

- 自分の得意な解き方に偏る

- 一度の出力では浅いミスが残る

ということがあります。

しかし、別の役割を持つAIがそれをチェックすると、違う角度から問題を見つけられることがあります。

つまり、 一つのAIが完璧であることを期待するより、複数のAIが互いの弱点を補う構造を作るほうが、実務では強い ということです。

私は、ここが今のAI業界で起きている変化の本質の一つだと思っています。

特にセキュリティで相性がよい理由

この考え方が特に分かりやすいのが、セキュリティです。

セキュリティはもともと、攻撃側が新しい手口を出し、防御側がそれに対応するという繰り返しで成り立っています。つまり、一度作った防御ルールを固定して終わりにはできません。

Mythos 関連の記事では、次世代モデルが「世界最高のセキュリティ研究者」に近い能力を持つ可能性や、未知の脆弱性を短時間で見つけられる可能性が示されています。さらに、防御側の企業も制約の少ないモデルを使い、攻撃者より先に脆弱性を見つけてパッチを当てる、いわば AI対AI の防衛戦 に入りつつあることが指摘されています。

ここで私が連想するのが、GANそのものではないにせよ、generator と discriminator を分けて相互作用させる発想です。

たとえばセキュリティ文脈では、

- generator 側 防御AIとして振る舞い、コード修正、パッチ生成、防御ルール追加、監視方針の更新を行う

- discriminator 側 その防御を破れるかを検証し、見落とされた脆弱性や未対応の攻撃経路をあぶり出す

という形が考えられます。

discriminator 側が弱点を見つけると、generator 側が防御を更新する。 その更新後の防御を、discriminator 側が再び破ろうとする。 このループを繰り返すことで、防御は一回限りの静的な対策ではなく、相互作用を通じて磨かれる動的な対策に変わっていきます。

重要なのは、ここでの discriminator が単なる採点役ではないことです。 最先端モデルが高水準のセキュリティ研究能力を持ちうるなら、discriminator 側もまた、実際に突破可能な経路を考え出す強い検証者である必要があります。 だからこそ、防御AIを generator とし、それを打ち破ろうとする別のAIを discriminator としてぶつける構図には意味があります。

私は、この仕組みの本質は、単体モデルに最初から完璧な防御を期待することではなく、防御を作るAIと、それを破ろうとするAIを相互作用させることで、学習データにない新しい穴や新しい守り方を継続的に見つけていくことにあると思っています。

もちろん、これは厳密な意味でのGANではありません。 本来のGANは、明確な目的関数のもとで generator と discriminator を同時最適化する学習手法です。 ここで述べているのは運用上のマルチAIループです。

ただし、生成する側と、それを打ち破る側を分け、その競争的な相互作用によって全体を強くしていくという意味では、GAN的な発想が、AIエージェント時代のセキュリティ設計に別の形で再登場しているようにも見えます。

この発想は、商取引やマッチングにも広がるかもしれない

この構図は、セキュリティだけに限らないはずです。

たとえば将来的に、AIエージェント同士のやり取りの規格と決済規格が整えば、

- 買い手AIが条件を提示する

- 売り手AIが条件に合う提案を返す

- 買い手AIが価格や納期を再交渉する

- 売り手AIが利益を守りつつ応答する

- 条件が収束した時点で、自動決済まで行う

という流れは、かなり考えうるケースだと思います。

これは人間の交渉の延長というより、AIエージェント同士が最適条件を探索する新しいやり方に近いです。 前回の記事で触れた402系の決済標準や、エージェント向け決済インフラは、まさにこの土台になりうるものです。

さらに言えば、この手の相互交渉は、

- 業務委託のマッチング

- 調達

- 保険条件の最適化

- 求人と求職のすり合わせ

- さらには個人間の恋人・パートナーマッチング

のような領域にも広がる可能性があります。

人間が自分で言語化しきれなかった条件まで含めて、AI同士が交渉し、候補を絞り込み、最適点を探る世界は十分ありうるということです。

懸念点

もっとも、この見方には注意点もあります。

第一に、複数AIを動かせば、リソースの肥大化・電力の消耗・サーバーの圧迫につながります。 無駄な相互批判やコンテキスト肥大で、コストだけが増えることもあります。

第二に、同じ系統のモデル同士で監視し合っても、同じ盲点を共有する可能性があります。 ガーディアンAIの文脈でも、監視するAIと監視されるAIが同じ特徴を持ったAIモデル群に依存している場合は限界があります。

第三に、AI同士の自律的交渉が広がるほど、決済、ユーザーの身分証明、責任分界、監査ログといった制度側の整備が不可欠になります。 技術だけでは完結しません。

ただ、それでも私は、この流れを過小評価しないほうがよいと思っています。 なぜなら今起きているのは、単なるモデル性能競争ではなく、AI同士が互いを補完し、監視し、評価し、交渉するための基盤づくりだからです。

まとめ

私は、これからのAIの本質は「一つのAIモデルがすべてを解く世界」ではなく、 複数のAIが proactive に動き、互いにレビューし、守り合い、ときには交渉しながら価値を生む世界にあるのではないかと思っています。

そしてその世界では、重要なのはAIモデル単体の性能だけではありません。

- どう役割分担させるか

- どう文脈を受け渡すか

- どう監視するか

- どう支払うか

- どう収束させるか

といったAIエージェント同士がやり取りするための土台作りが、競争力になります。

そう考えると、GANのような少し前の発想が、AIエージェントという新しい器をまとって再び意味を持ち始めている、と見ることもできます。 古い概念が消えたのではなく、より大きな実務システムの中で再解釈され始めたのかもしれません。

この記事についてのLinkedIn投稿でコメントや意見を共有できます。

LinkedInで議論する