NVIDIAが描く「1兆ドルの計算基盤」:推論チップ統合で見えてきた、AIインフラの全方位エコシステム

今回のGTC 2026において、ジェンセン・ファン氏が示したロードマップは、単なる次世代チップの性能向上に留まるものではありませんでした。それは、自社の強みである「学習」に、外部の優れた「推論」技術やエージェントの実装環境を組み合わせることで、AIに関わるすべてのプロセスを自社経済圏に引き込む、極めて戦略的なエコシステムの構築であると考えられます。

世界がNVIDIAの新型チップ「Blackwell」や「Vera Rubin」に注目する中、重要な変化は、これまでライバルとされていた技術をも自らのプラットフォームに取り込み、AIの「入口から出口まで」を自社規格で塗り替え始めた点にあります。

1兆ドルという壮大な売上目標の背後には、計算リソースの「学習から実装まで」を完全に掌握しようとする、NVIDIAの強い意志が感じられます。

Reutersは、NVIDIAが2027年までにBlackwellとRubin関連で1兆ドル超の売上機会を見込む一方、今回のGTCではとくに推論向け製品を前面に出したと報じています。

事実として確認できること

今回の発表および周辺の市場動向において、公的に確認できる主要な事実は以下の通りです。

1兆ドルの累積売上予測と市場のコンセンサス

NVIDIAは、2025年から2027年までの3年間で、BlackwellとRubin関連の売上機会が1兆ドルを超えるとの見通しを示しました。Reutersは、この見通しが昨年の5000億ドル予測からの大幅な引き上げであること、そしてこの数字が依然としてGroq関連や中国向け旧世代チップ売上を含まないことを伝えています。

Groq技術の統合と「推論」への本格進出

Reutersは、NVIDIAがGTCでGroq技術を用いた推論向けシステムを打ち出し、推論を次の成長軸として明確に位置づけたと報じています。NVIDIA公式も、Vera Rubin platformの構成要素としてGroq 3 LPX inference accelerator racksを掲げています。

Samsung活用による供給網の分散

Reutersは、Samsung ElectronicsがNVIDIAの新しい推論チップを4ナノで製造すると報じています。これは、NVIDIAが推論向けの新しい構成要素について、TSMC一極集中を避けながら量産体制を広げようとしている動きとして受け止められています。

Intelの関与が示す過渡期の実装

一部報道では、Groqを組み込んだ新しいラック構成では、通信管理の一部にIntel製プロセッサが使われるとされています。これは、NVIDIAが推論特化チップを急速に自社エコシステムへ組み込む過程で、すでに完成された自前主義ではなく、必要な部材を外部からも取り込みながら実装を急いでいることを示す材料です。

競合セレブラス(Cerebras)の台頭

Bloombergは、CerebrasがMorgan Stanleyを起用し、早ければ4月にもIPOに戻る可能性があると報じています。これは、推論や特殊用途を含むAI半導体市場がまだ完全な一極集中に至っておらず、資本市場が依然として別アーキテクチャにも勝機を見ていることを示しています。

エージェント開発ツール「NemoClaw」の発表

Reutersは、NVIDIAがNemoClawを発表し、より安全で実務向けのAIエージェント実装基盤を整えようとしていると報じています。これは単なるモデル提供ではなく、AIエージェントが企業内で実際に動くための制御レイヤーまで握ろうとする動きです。

レイヤーごとの整理

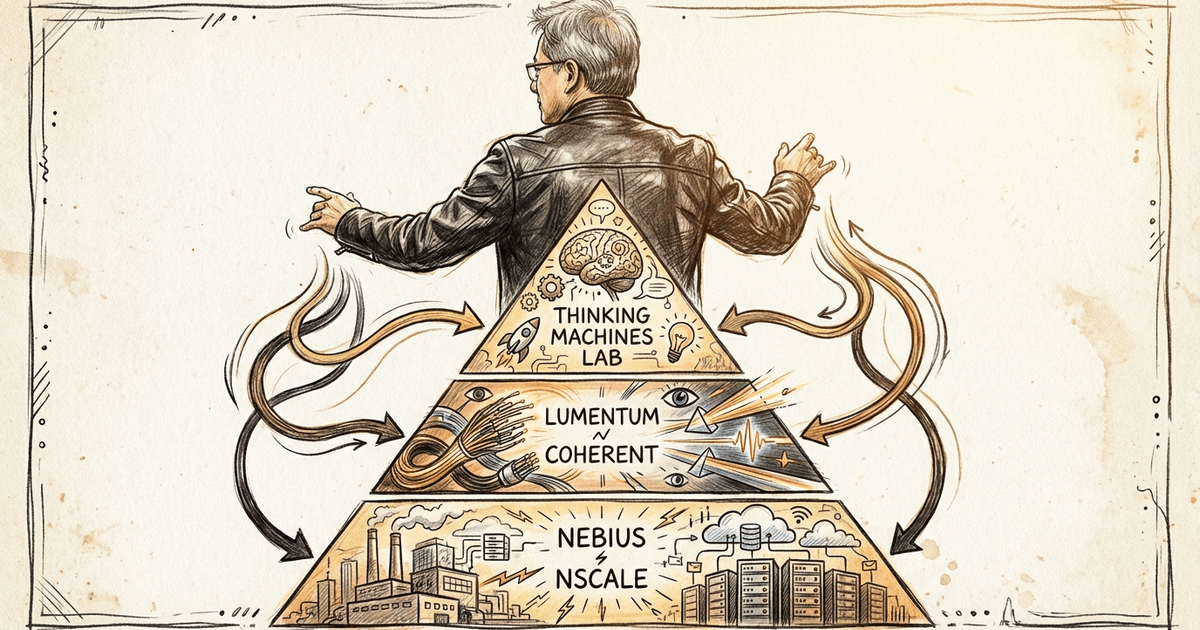

AIインフラの各階層において、NVIDIAは以下のようにエコシステムを囲い込もうとしています。

プロセッサ層(学習+推論の融合)

GPUによる「学習」での圧倒的な地位を維持しつつ、Groqの技術を統合。これにより、Cerebrasのような「推論の速さ・効率」を売りにする競合へ顧客が流出することを防ぎ、NVIDIAのラック内で学習と推論の両方を完結させる体制を整えています。

製造層(Samsung活用と脱TSMC一本足)

Samsungの4ナノ製造を使うことで、NVIDIAは推論向けチップの供給をTSMC一本に依存しない形へ広げています。私の見方では、これは単なるコストの話ではなく、地政学リスクや供給制約を見据えた製造面での包囲網です。推論市場が拡大する中で、供給先そのものを複線化しておく意味は大きいと考えられます。

実装層(Intel利用が示す現実主義)

一部報道では、Groq統合ラックの通信管理にIntel製プロセッサが使われるとされています。これは、自社のあらゆる部材だけで閉じるというより、推論市場での主導権確保を優先し、必要ならIntelの部材すら取り込みながら実装を前に進める現実主義を示しています。私の意見では、ここにNVIDIAの強さがあります。競合を正面から排除するだけでなく、必要な要素は自社の秩序の中へ組み込んでしまうからです。

ソフトウェア層(エージェントの実装標準)

NemoClawの提供により、AIが実務を遂行する際の手足の規格を握ります。安全な運用環境を提供することで、背後で動く膨大な推論リソースの消費を自社インフラに固定する狙いが見えます。

キャピタル層(需要の自己循環)

NVIDIAはNebiusに20億ドルを投資し、そのNebiusはMetaと最大270億ドル規模のAI capacity契約を結びました。これにより、NVIDIAは単にチップを売るだけでなく、そのチップを消費する器そのものにも資本を入れ、需要を自社エコシステムの内側で増幅させる構造を強めています。

私見

今回の動向は、NVIDIAが「学習の覇者」という立場に甘んじることなく、AIに関わるすべての要素を自社中心の円環に取り込もうとしている証左と考えられます。

特にCerebrasのIPO観測が強まる中、Groqの技術を取り込み、Samsungで量産体制を広げ、必要に応じてIntelの部材も使いながら、NemoClawでエージェントの実装環境まで提供し始めたことは、ライバルの武器すらも自らのプラットフォームを構成するパーツへと変えてしまったことを意味します。

知能(モデル)そのものはコモディティ化しても、それを高速かつ安全に動かすための器(ハード)、その制御(ソフト)、そして製造・資本をNVIDIAがパッケージ化して提供することで、AIサービスに関わるすべてのプレイヤーは、気づけばNVIDIAのエコシステムで完結してしまいます。

これは競合を排除するのではなく、競合の価値を自社システムの一部として無力化する、極めて高度な戦略と私は考えます。

別の見方

この強気な成長シナリオには、案件固有の構造的リスクも存在します。

統合コストと技術的負債

Intel製プロセッサを通信管理に使う構成が事実だとすれば、それは同時に、Groq統合がまだ過渡期の設計であることも示します。推論市場で急ぐあまり、将来的に複雑な統合負債を抱える可能性はあります。

物理層のボトルネック

1兆ドル規模のインフラを支えるには、広大な土地と膨大な電力供給が不可欠です。Groq統合やSamsung活用で半導体供給を前に進めても、データセンター立地、送電網接続、地域の受容性といった物理制約は別問題として残ります。

まとめ

それでも、このニュースが重要なのは、AIの主導権争いが、もはや単一の性能を競う段階ではなくなっていることを示しているからです。

争点は、学習、推論、エージェントの実装、製造の分散、そして資本の還流まで広がっています。

今回の構図は、それらすべてをNVIDIAという一つの巨大なエコシステムの中に取り込もうとする全方位の動きを、1兆ドルという数字と、Groq・Samsung・Intelを巻き込んだ形で示しています。

この記事についてのLinkedIn投稿でコメントや意見を共有できます。

LinkedInで議論する