NVIDIA、新興企業への出資でAIインフラ全体の主導権を強める

NVIDIAの最近の資本戦略を見ていると、関心の対象は半導体単体にとどまっていないように見えます。

新興企業への出資や長期供給契約を通じて、AI計算資源の供給力、データセンター、光接続、AIスタートアップといった周辺レイヤーにも関わりを広げています。こうした動きを並べてみると、NVIDIAはGPUの販売だけでなく、AIインフラ全体の主導権を強めようとしているようにも見えます。

1. 事実として確認できること

1-1. クラウド・データセンター側への出資

Reutersによると、NVIDIAはAIクラウド企業Nebiusに20億ドルを投資し、約8.3%の株式を取得しました。Nebiusは2030年までに5GW超のデータセンター容量を整備する計画を示しています。

また、Nscaleについても、ReutersはNVIDIAが支援する企業として報じています。Nscaleは20億ドルの資金調達を行い、評価額は146億ドルに達しました。同社は自社データセンター、GPU、ソフトウェアスタックを持ち、需要拡大に対応するため容量を増やす方針とされています。

この2件から分かるのは、NVIDIAがGPUを供給するだけでなく、そのGPUが使われる計算基盤の拡張にも関わっていることです。これは単発の販売ではなく、需要を受け止める「器」の側にも資本が向かっている、ということです。

1-2. 光通信レイヤーへの関与

Reutersは、NVIDIAがLumentumとCoherentに対し、それぞれ20億ドル規模の投資を行う計画だと報じています。目的は、フォトニクス関連の研究開発と製造能力の拡充です。

AIシステムが大規模化すると、問題は演算性能だけでは終わりません。チップ間、ラック間、クラスタ間で大量のデータをやり取りする必要があるため、接続の方式そのものが性能や電力効率に影響します。Reutersの報道からは、NVIDIAがこの部分を重要な構成要素として扱っていることが読み取れます。

1-3. AIスタートアップとの資本・供給関係

Reutersによると、Mira Murati氏のThinking Machines Labは、NVIDIAから重要な出資を受けるとともに、少なくとも1GW規模の次世代Vera Rubinシステムにアクセスできる契約を結びました。NVIDIA自身も公式ブログでこの提携を説明しています。

ここで確認できるのは、NVIDIAが単なる半導体供給者ではなく、AIスタートアップに対する資本提供者としても存在感を強めていることです。将来の大口需要先になりうる企業に対して、早い段階から資本と供給の両面で関わっているとも読めます。

1-4. NVIDIA自身の説明も変わっている

NVIDIAの年次報告書では、同社の提供するものはGPU単体ではなく、GPU、CPU、DPU、インターコネクト、スイッチ、システム、ネットワーク、ソフトウェアを含む「data center scale infrastructure」として説明されています。

また、顧客やパートナーがAIインフラを拡張するうえで、データセンター、エネルギー、資本の確保が重要であり、これらが不足すると将来の業績に影響しうるとも記載されています。

この開示資料の書き方を見ると、NVIDIA自身が競争の単位を「チップ販売」だけでは捉えていないことが分かります。少なくとも会社の自己認識としては、すでに「データセンター全体を動かすための基盤」に近づいています。

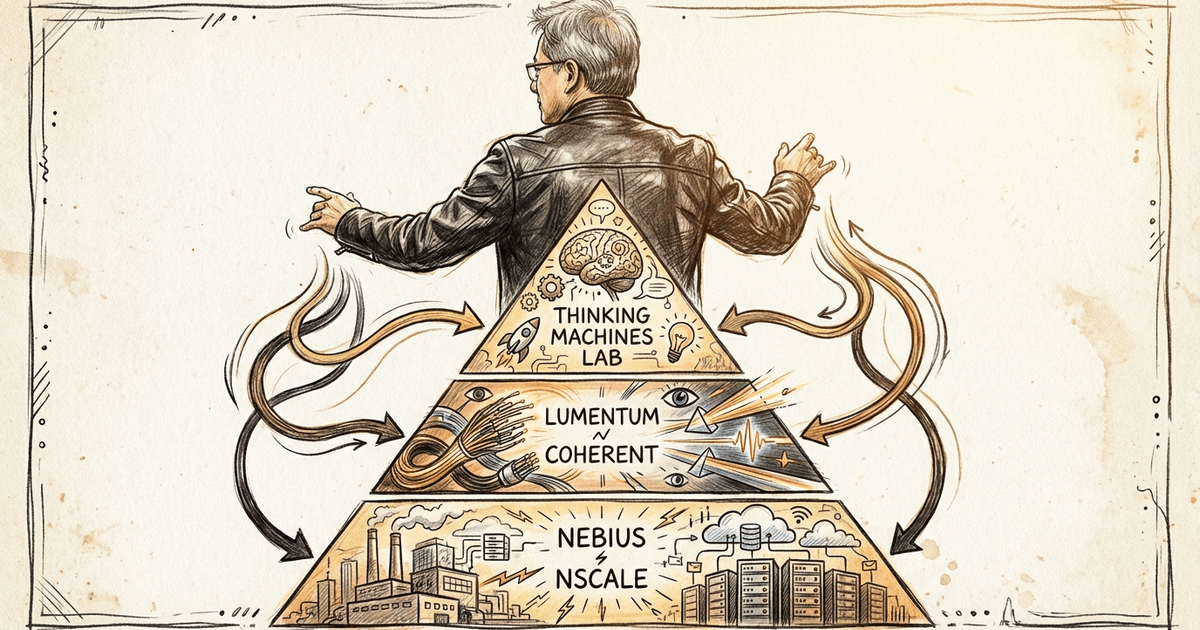

2. ここまでの事実を並べると何が見えるか

上の内容を、レイヤーごとに整理するとこうなります。

- クラウド・AI計算資源の供給力 — Nebius、Nscale

- 光接続 — Lumentum、Coherent

- AIモデル — Thinking Machines Lab

この並びを見ると、投資先はバラバラというより、AIインフラの主要部分に沿って配置されているように見えます。

3. 私の意見:NVIDIAは「GPUの外側」にも関わり始めている

ここからは私自身の見方です。

最近の一連の動きは、単純な投資先の分散というより、AIインフラの主要なボトルネックに対して資本を入れているように見えます。

AIの競争は、以前よりもかなり構造が複雑になっています。高性能なGPUを作るだけでは足りず、それを動かすデータセンター、十分な電力、効率のよい接続、そして実際に計算資源を消費する顧客やAI企業が必要になります。

そのため、NVIDIAにとって重要なのは「次のGPUを売ること」だけではなく、そのGPUが継続的に使われる環境を広く整えていくことになっているのではないかと思います。

たとえば、今回の動きを整理すると、次のように読むことができます。

- NebiusやNscaleへの関与 — GPUを受け入れるAI計算資源の供給力やデータセンターの拡張に関わる動き。

- LumentumやCoherentへの関与 — 大規模AI計算に必要な光接続や通信部分を強くする動き。

- Thinking Machinesとの関係 — 将来大規模に計算資源を使うAIラボと、資本・供給の両面で早くから結びつく動き。

こうして見ると、NVIDIAは「すべてを自前で所有する」という意味での古典的な垂直統合を進めているというより、AIインフラの中で詰まりやすい部分に先回りして関わり、自社GPUを中心にした構造を保とうとしているように私は思います。

4. 別の見方

ただし、この動きをあまり一方向に読みすぎないほうがよいとも思います。

NVIDIAの出資や供給契約は、必ずしも「垂直統合の支配」を意味するとは限りません。AIインフラ市場そのものがまだ急拡大の初期段階にあり、データセンター、電力、光接続、AIラボのどこも供給が不足しています。

そう考えると、NVIDIAの行動は支配戦略というより、自社製品の需要を支えるための自然な投資行動とも説明できます。

また、出資先がそのままNVIDIAの支配下に入るわけでもありません。クラウド事業者やAIラボは、状況次第でAMD、自社チップ、別の推論基盤へ広がっていく可能性があります。実際、ReutersはCerebrasをNVIDIAの競合として報じており、AIインフラ全体がNVIDIA一色になっているわけではありません。

そのため、現時点で「NVIDIAがすべてを握ろうとしている」と断定するのは少し強すぎます。AIインフラの重要な層で存在感を強めている、と見るくらいが自然だと思います。

5. まとめ

今回のNVIDIAの投資は、個別のベンチャー投資として見るより、AIインフラ全体を自社中心に組み上げていく動きとして見たほうが分かりやすいと思います。

ポイントを短くまとめると、次の3点です。

- NVIDIAはGPUを売るだけでなく、そのGPUが使われる周辺レイヤーにも資本を入れ始めている

- 投資先は、新興企業を通じてクラウド・AI計算資源の供給力、光接続、AIモデルといった重要レイヤーに広がっている

- その結果として、NVIDIAはAIインフラ全体を自社中心の構造に近づけようとしているように見える

言い換えると、NVIDIAが進めているのは、すべてを自前で持つ古典的な垂直統合というより、出資先や供給先を勢力圏に置きながら、AIの主要レイヤーを自社中心に束ねていくやり方です。

大手テック企業に対しては、NVIDIAは重要な供給者ではあっても、経営や製品戦略まで主導できる立場にはありません。それに対して新興企業であれば、出資、供給契約、技術依存を通じて、より強い影響力を持ちやすい可能性があります。今回の一連の動きは、そうした構図として読むこともできます。

ただし、別の見方もあります。これらの投資は、AIインフラの将来を押さえる戦略というより、出資先にNVIDIA製GPUを大量導入させることで、需要を先回りして作り、自社の売上を押し上げているだけではないか、という見方です。

実際、出資先の多くは同時にNVIDIAの顧客でもあります。そのため、エコシステム形成と見ることもできれば、循環的に需要を支え合う構図と見ることもできます。

現時点では、そのどちらか一方に決めつける必要はないと思います。ただ少なくとも、NVIDIAが半導体企業の枠を超えて、新興企業群を足場にAIインフラ全体への影響力を強めようとしていることは、かなりはっきりしてきています。

NVIDIAの最近の動きは、チップを超えてAIインフラ全体の秩序を自社中心に組み替えようとしているようにも見えます。その変化をどう読むかが、これからのAIインフラを見るうえで大事になりそうです。