CXLが示すAIデータセンターの次の変化:メモリ共有と光接続が広げる新しい設計

AIインフラの話題では、GPUやTPUなどの半導体とHBMがセットで語られることが多いですが、ここへ来てもう一つ重要な技術が注目され始めています。CXL(Compute Express Link) です。

まず簡単に言うと、CXLとは「メモリをサーバーの外に出して共有できるようにする接続規格」 です。

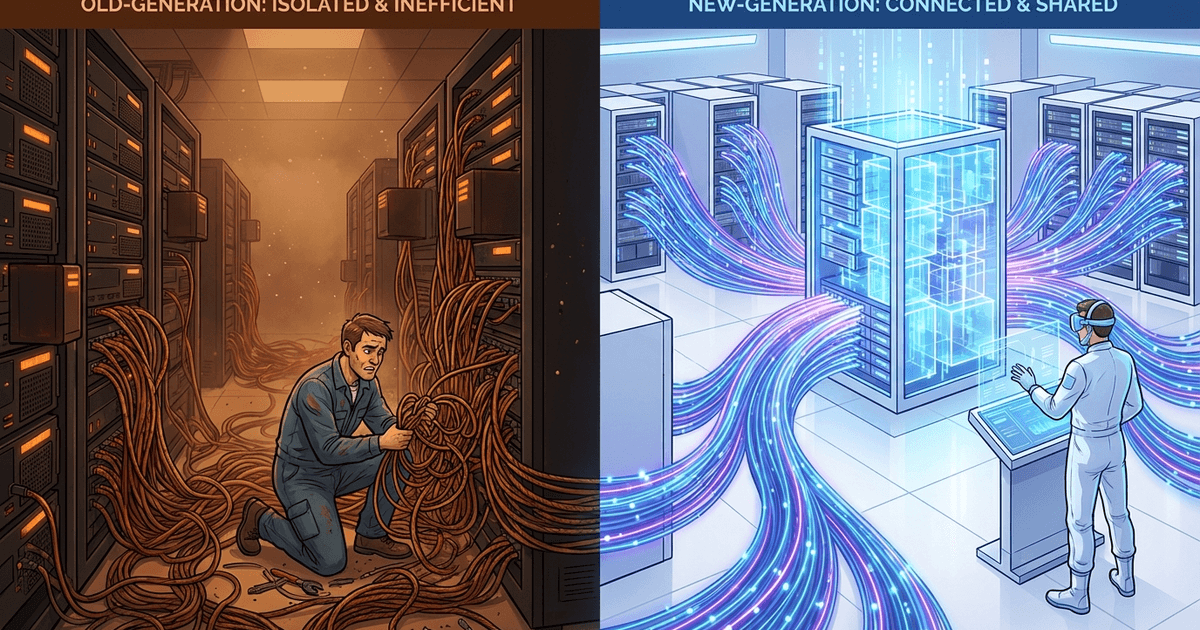

これまでのサーバーでは、メモリは各サーバーのマザーボードに固定されていました。そのため、あるサーバーでメモリが余っていても、別のサーバーがそれを使うことはできませんでした。

CXLは、この制約をゆるめます。サーバーの外にあるメモリ装置へプロセッサが直接アクセスできるようにし、データセンター全体でメモリを共有する仕組みを作るための技術です。

つまり、これまで「サーバーごとに閉じたメモリ」だったものを、「データセンター全体で使えるメモリ」へ近づける技術と言えます。

The Information の報道によると、CXLは新しい概念というより、数年前から存在していたオープンな規格です。

にもかかわらず、これまで大規模導入が進まなかったのは、CPU、GPU、メモリ、コントローラ、ソフトウェアまで含めて、業界全体の足並みがそろわないと機能しにくい技術だったからです。The Information は、まさにその調整の難しさが商用化を遅らせてきたと報じています。

ただし、今は状況が変わってきました。

AIブームでメモリ不足とメモリ価格高騰が進み、Google が自社データセンターで CXL を使い始めたと The Information は報じています。さらに NVIDIA の次期 Vera CPU は Gen6/CXL 3.1 をサポートすると、NVIDIA 自身の技術ブログに明記されています。CXL は「面白い規格」から、「使わざるを得ない技術」に近づきつつあります。

私の意見としては下記になります。

CXLの本質は、単に「メモリを足せる技術」ではないと思っています。HBM中心だったAIメモリ構成に共有と階層化の発想を持ち込み、さらに電気配線だけでは厳しくなる部分を光で補う。重要なのは、この変化が同時に起き始めていることです。

もしこの流れが本格化すれば、データセンターはもっと身軽になるかもしれません。これまで重くのしかかっていたメモリ、配線、電力、冷却の制約を少しずつ外しながら、全体をより効率的に回せる方向へ進む可能性があります。

以下、事実と見解を分けて整理します。

1. まず事実として、いま何が起きているか

1-1. CXLは「サーバーごとに閉じていたメモリ」を共有可能にする技術

The Information の説明によれば、従来のサーバーではメモリは各サーバーのスロットに固定され、隣のサーバーでメモリが余っていても借りることはできませんでした。CXL は、この制約をゆるめ、データセンター内の別の場所にあるメモリへプロセッサがアクセスできるようにする技術です。Google はすでに、CPU と外部メモリプールの間に CXL コントローラを入れ始めていると報じられています。

CXL 規格自体も進化しています。ABI Research の CXL 3.1 解説資料では、CXL 2.0 で switching と memory pooling、CXL 3.0/3.1 で advanced switching や accelerator 間の memory sharing が拡張されてきた流れが整理されています。CXL 3.1 は PCIe 6.1 ベースで、双方向 128Gbps までの転送をサポートするとされています。

1-2. NVIDIAはVeraでCXL 3.1を正式サポートする

NVIDIA の技術ブログでは、Grace と Vera の比較表に “PCIe/CXL Gen6/CXL 3.1” と明記されています。Vera は CPU 側で最大 1.5TB の LPDDR5X メモリを使い、Rubin GPU 側の HBM4 とも、NVIDIA 独自の高速接続技術 NVLink-C2C で緊密につながる設計です。要するに、CPU側の大容量メモリとGPU側の超高速メモリを、なるべく一体に近い形で使おうとしているわけです。

NVLink は、NVIDIA が開発している高速接続技術です。GPU同士、あるいは CPU と GPU を、PCIe より高速・低遅延でつなぐための独自インターコネクトで、NVLink-C2C の C2C は chip-to-chip を意味します。

NVIDIA は、HBM だけでなく、より大きな外部メモリ階層を含めて AI ファクトリー全体を設計し始めています。

CXL は規格だけあっても普及しません。実際に大きなエコシステムを持つプレイヤーが CPU 側で正式に支えることで、初めて現実味が出ます。Vera の登場は、CXL にとって大規模な実地試験になると位置づけられています。

1-3. Googleはすでに「光でつなぐ」運用ノウハウを持っている

Google は CXL そのものだけでなく、その先の物理層でも先行しています。Google Cloud の公式ブログによれば、同社は Jupiter データセンターネットワークで、OCS(Optical Circuit Switching、光回線スイッチ)と、WDM(Wavelength Division Multiplexing、波長分割多重)を8年以上統合してきました。OCS は光の接続先を切り替える技術で、WDM は1本の光ファイバーに複数の光信号を同時に流して通信容量を増やす技術です。Google はこれにより、性能向上、低遅延、低コスト、低消費電力、ゼロダウンタイム更新などを実現してきたとしています。

TPU 側でも同じ発想が使われています。Google Cloud は、TPU v4 について、4096個のチップを自社開発の光スイッチ技術でつないだ構成だと説明しています。また Ironwood でも、接続先を状況に応じて切り替えられる光ネットワークを使っているとしています。つまり Google は、データセンター全体の通信だけでなく、AI計算を支えるチップ同士の接続でも、すでに光技術を本格運用しているということです。

1-4. NVIDIAも光デバイス側へ資金を入れ始めた

Reuters の報道によると、NVIDIA は Lumentum と Coherent にそれぞれ 20億ドルを投資するとされています。記事では、NVIDIA が photonics を使って AI プロセッサの高速化を図ろうとしていること、そして高度なレーザーや光ネットワーク製品へのアクセスを確保しようとしていることが示されています。

これは単なる周辺投資ではなく、NVIDIA が「次世代AIデータセンターは光抜きでは成立しない」と見ていることの表れだと思います。Google が運用ノウハウで先行し、NVIDIA がサプライチェーン投資で追う、という構図が見えてきます。

2. 私の意見:本質は「CXL単独」ではなく、3つの変化の同時進行にある

ここからは私の意見です。

私は、今回の論点を単純に「CXLが流行るかどうか」で見るべきではないと思っています。重要なのは、次の3つが同時に動いていることです。

- HBM中心だったメモリ構成の変化

- 銅線と電気信号の限界から、光通信への移行

- サーバーごとに閉じていたメモリを共有する仕組み

この3つが重なると、データセンター設計の前提そのものが変わります。

2-1. HBMは消えないが、「HBMだけで全部やる」発想は変わる

まず大事なのは、CXL は HBM を追い出す技術ではないということです。GPUのすぐ近くにある超高速メモリは、これからもAI計算の中核であり続けるはずです。

NVIDIA の Rubin / Vera を見ても、その点は変わっていません。GPU 側には HBM4、CPU 側には大容量の LPDDR5X が置かれています。つまり今起きているのは、「HBMか、それ以外か」という話ではなく、近くの超高速メモリに加えて、外側にも大きなメモリ層を持たせるという設計の変化です。

これまで AI インフラでは、超高速メモリをできるだけチップの近くに置く方向が圧倒的に重視されてきました。もちろんその価値は今後も大きいです。

ですが、価格、容量、供給、実装の制約を考えると、「全部を高価な近接メモリで賄う」のは限界があります。The Information も、メモリ価格高騰が各社を CXL に向かわせていると書いています。

私には、HBM は最前線、CXL メモリは後方支援、という現実的な分業が始まったように見えます。

2-2. 銅線と電気信号の限界が、光への移行を押している

ただし、CXL を広げればそれで終わりではありません。次の壁は、転送そのものです。

電気信号は距離が伸びるほど扱いが難しくなり、高速化すると信号劣化、電力、発熱、冷却の問題が重くなります。

CXL 3.1 は PCIe 6.1 ベースで帯域を伸ばしていますが、遠くのメモリまで含めて大規模にプール化しようとすると、物理層の負担はむしろ重くなります。距離が伸びるほど、配線、消費電力、発熱、信号の扱いが難しくなるからです。

要するに、CXL でメモリ共有の仕組みを作っても、その先の配線と信号伝送がボトルネックになるわけです。Google が Jupiter(自社データセンター内の大規模ネットワーク基盤)で OCS と WDM を使っているのも、そのボトルネックを光で和らげようとしているからだと理解できます。

ここで光通信が効果的な役割を果たします。

Google はすでに、TPUを結ぶ光ネットワークや、Jupiter で、「光でつなぐ」運用経験を積んできました。一方の NVIDIA も、Lumentum や Coherent のような、光通信や光学部品を手がける企業への大型投資でその方向に動いています。

つまり、CXLでメモリ共有を広げる流れと、光でその物理的な制約を和らげる流れが、ここへ来て同じ方向を向き始めているように見えます。

2-3. その先には、データセンターの設計そのものの変化がある

Google は OCS を、単に高速でつなぐための技術としてではなく、状況に応じてつなぎ方そのものを切り替えられる光ネットワークとして位置づけています。

Jupiter でも TPU でも、重要なのは「つながっている」こと以上に、「必要に応じてつなぎ方を変えられる」ことです。

もし CXL による共有メモリと、光による再構成可能な接続が本格化すれば、今後のデータセンターは「このサーバーにメモリが何枚刺さっているか」ではなく、「建物全体でどれだけの計算資源と記憶資源を動的に組み替えられるか」で最適化される可能性があります。

私はこの点を高く評価しています。CXL単体がすごいというより、メモリの所有権を固定から共有へ、接続を銅から光へ、設計単位をサーバーからデータセンター全体へ動かす可能性があることに、大きな意味があると思っています。

もしこの流れが本格化すれば、データセンターはかなり身軽になるかもしれません。これまで足かせだったメモリ配置、配線、電力、冷却といった物理的な制約がやわらぎ、ラックの組み方や資源の使い方そのものが変わっていく可能性があります。結果として、データセンター全体をより効率よく、よりコスト効率よく回せるようになるかもしれません。

3. 懸念

ここまでかなり前向きに書きましたが、反論や懸念もあります。

3-1. Google自身が「CXL memory poolingには反対論」を出している

非常に重要なのは、Google Research に “A Case Against CXL Memory Pooling” という論文があることです。そこでは、CXL memory pool には cost、complexity、limited utility の3つの問題があると主張されています。

要点は、CXL は主メモリよりかなり高遅延で、Ethernet と並列の新しいケーブリング・スイッチ基盤が必要になり、そのコストが RAM 節約効果を打ち消す可能性がある、というものです。

これはかなり重い反論です。つまり Google は実運用で CXL を試しつつも、研究レベルではまだ「万能ではない」と見ている。この点は大きな懸念の一つです。

3-2. 業界全体の足並みは、今でも難しい

The Information も、CXL の大きな障害は、CPU、GPU、メモリ、ソフトウェアまで全部が同じ言語を話さなければならないことだと説明しています。

規格が進化するたびに、プロセッサ再設計、コントローラ、スイッチ、メモリモジュール、サーバー互換性試験まで全部が連鎖して影響を受けます。

この手の技術は、理想だけでは広がりません。「Google と NVIDIA はできるかもしれないが、業界全体には時間がかかる」という懸念は自然だと思います。

3-3. 光通信も万能ではない

Google は OCS の効果を強調していますが、同時にそれは、長年にわたる自社設計、自社運用、SDN 統合の成果でもあります。

一般企業がすぐ同じものを再現できるわけではありません。OCP が OCS の相互運用を進めているのは、裏を返せば、まだ標準化やエコシステム形成が途中だということでもあります。

さらに光学部品は、製造難度、実装、保守、信頼性評価のハードルも高い。NVIDIA が Coherent と Lumentum に巨額投資しているのは、そこがまだ普及に時間がかかる技術だからであり、見方によっては時間をお金で買っているとも受け取れます。

4. まとめ

CXLの意義は、単にメモリを増やせることだけにはないと思います。メモリを共有して使うという考え方が現実味を帯びてきたこと、そして電気配線だけでは難しい部分を光接続で補おうとする流れと重なってきたことが、より重要に見えます。

もしこの流れが本格化すれば、データセンターはかなり身軽になるかもしれません。

これまで足かせだったメモリ配置、配線、電力、冷却といった物理的な制約がやわらぎ、ラックの組み方や資源の使い方そのものが変わっていく可能性があります。結果として、データセンター全体をより効率よく、よりコスト効率よく回せるようになるかもしれません。

HBMだけを見ていればよかった時代から、メモリ階層、共有、そして光の物理層まで見ないと全体像がつかめない時代に入りつつあると考えております。