AI経済の死活問題 ── OpenAIの赤字見通しと推論チップ覇権争いの裏側

The Informationの最新レポートによると、OpenAIの 粗利率(Gross Margin)は2024年の40%から33%へと下落 しました。自社予測の46%を大きく下回り、サブスクリプション型のAIサービスとしては厳しい収益体制に陥っています。

その原因は、急速に膨らむ 推論(Inference)コスト です。昨年、OpenAIがクラウドプロバイダーに支払った推論費用は、前年比4倍の**84億ドル(約1.3兆円)に達しました。当初予測の66億ドルを大幅に超過しています。さらに、2030年にはこのコストが年間850億ドル(約13兆円)**に達すると予測されています。

この「1トークンあたりの赤字」を垂れ流す構造こそが、黒字化を阻む最大の障壁です。今、AIの覇権は「いかに賢いモデルを作るか(学習)」から、いかに安く、速く、1トークンを量産するか(推論) という、地味ながらも熾烈な「シリコンの物理学」の競争へと移行しています。

「学習の王者」NVIDIAが直面する推論の非効率

学習フェーズにおいて、NVIDIAのGPUはHBM(高帯域メモリ)を駆使した圧倒的な汎用性で王座に君臨しています。しかし、1秒間に数万件の回答を生成する「推論」フェーズでは、この高価なメモリとプロセッサ間でのデータ往復が「遅延(レイテンシ)」と「電力浪費」の元凶(Memory Wall)となります。

OpenAIがこのままNVIDIAのGPUだけで推論を回し続ければ、ビジネスモデルが破綻しかねません。これが現状の危機感の正体です。

「推論コスト10分の1」への挑戦者たち ── SRAMの逆襲

こうした課題に対し、NVIDIAとは全く異なるアーキテクチャで推論効率を追求するチップベンチャーが台頭しています。

-

Cerebras(セレブラス): 巨大な「ウェハスケール」チップにより、モデル全体をプロセッサ上のSRAM(静的メモリ)に載せ、データの移動をゼロにします。OpenAIが10億ドル規模の契約を交わしたのは、この圧倒的な推論効率に賭けているからです。

-

Groq(グロック): 独自のLPUにより、逐次的処理を極限まで高速化。リアルタイム性が求められるAIエージェントの「神経」として注目されています。特筆すべきは、NVIDIAが2025年12月に200億ドル規模の契約を結び、Groqから主要な人材を引き抜き、技術ライセンスを取得したことです。これは、NVIDIAが自社の弱点である「推論効率」を補完するために行った事実上の買収であり、推論特化型チップの重要性を王者が自ら認めた瞬間でもありました。

-

Etched(エッチド): 汎用性を捨て、AIの基本アルゴリズムである「Transformer」をハードウェアに焼き付けたASIC。GPU比で20倍以上の効率を狙う、まさに「推論特化」の極致です。

-

Tenstorrent(テンストレント): 伝説の設計者ジム・ケラー率いる、RISC-Vベースの柔軟なアーキテクチャでコストパフォーマンスを追求しています。

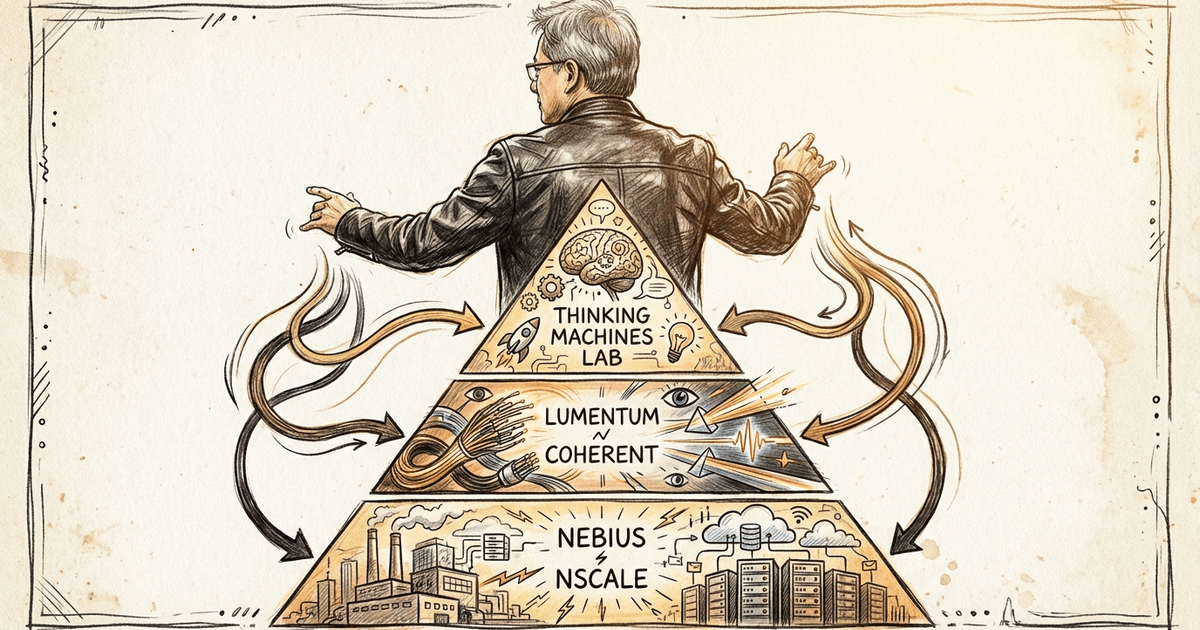

私の視点:インフラの「二階建て」構造

私の考えでは、今後のAIインフラは明確に二極化していきます。

-

学習・高度推論(NVIDIA): モデルの根幹を作る、揺るぎない「知能の源泉」。

-

日常推論(Cerebras / Groq / Etched / TPU): 1トークンの単価を極限まで下げる「知能の量産工場」。

Googleが自社専用のTPUで推論コストを抑え込み、垂直統合で先行しているように、OpenAIもまたCerebrasや自社開発チップ(Broadcomと共同開発中)へと舵を切りました。

結論:AI経済の真の勝者

「黒字化への鍵」は、もはや大規模言語モデルのIQの高さではなく、シリコンの上にどれだけ効率的に知能を焼き付けられるかという物理の戦いに移っています。

1トークンの単価が「1セントの数分の一」にまで下がったとき、初めてAIは「道具」から、私たちのスマートグラスなどを通じた「身体の一部」として溶け込んでいくはずです。